演講講稿:民主化AI的實驗與展望

點子松論壇講稿:民主化AI的實驗與展望

1

對不起,我只是一個大型語言模型。

聽過這句話的朋友可否幫我舉個手?

舉手的朋友都是專家,因為你問倒了ChatGPT

問對問題,是我今天演講的主題。

我其實也是數位部訓練出來的大型語言模型,

我叫黃豆泥,來自多元宇宙科。

基本上都是看唐鳳的逐字稿長大的,來形成我這個AI。

今天大多數的內容也是從逐字稿來的。

2

三年前我在醫院當住院醫師時,

晨會報論文,講過一個笑話。

這是一個在研究用AI是否可以幫忙判斷癌症的論文,

研究人員在餵資料給機器時,忘記遮掉影像上面的報告,

AI因此作弊,不看影像,

直接看報告上的字,分析出正確答案,

研究人員還傻傻的以為機器很聰明。

當我講完時,主治醫師們都笑得很爽。

他們覺得機器還不會取代他們。

事實上,許多老鳥員工面對老闆,也是一樣的問題,

這些活下來很久的員工,知道老板喜歡什麼,不喜歡什麼。

往往可以揣摩上意,趨吉避凶。

但當老闆退休,或這些老鳥員工轉職後,

他們反而會不知道該怎麼繼續討好新老板。

這類的問題,我們稱之為過擬合(Overfitting),

人工智慧太能夠專注在一個案例,而無法處理其他類似的問題。

其實人類也會一樣。

比如說剛剛講的冷笑話,在醫院講大家可能會覺得很好笑,

但是在這裡講,便沒那麼好笑。

其實過擬合呢,就是偏見。

偏見不好也不壞,偏見可以讓你在社會上更方便的生存,

但有時也會對其他社會的人帶來災難。

3

AI一定是有偏見的,

無論這個偏見來自於超大量的訓練資料、

肯亞低薪勞工標記員、

或設計出演算法的工程師。

如何「超克偏見,便是一個重要問題」。

唐鳳認為,能夠超越偏見的,

只有讓每一個人都繼續保有偏見,

並且願意尊重彼此差異,繼續進行合作,

這便是多元宇宙的精神。

如何讓每一個人都保有偏見,

那便是分散式AI,

如果每一個人的手機、電腦、電視,

都能夠擁有超級客製化的AI,

在那個時代,我們便能擁有屬於自己的最佳個人助理。

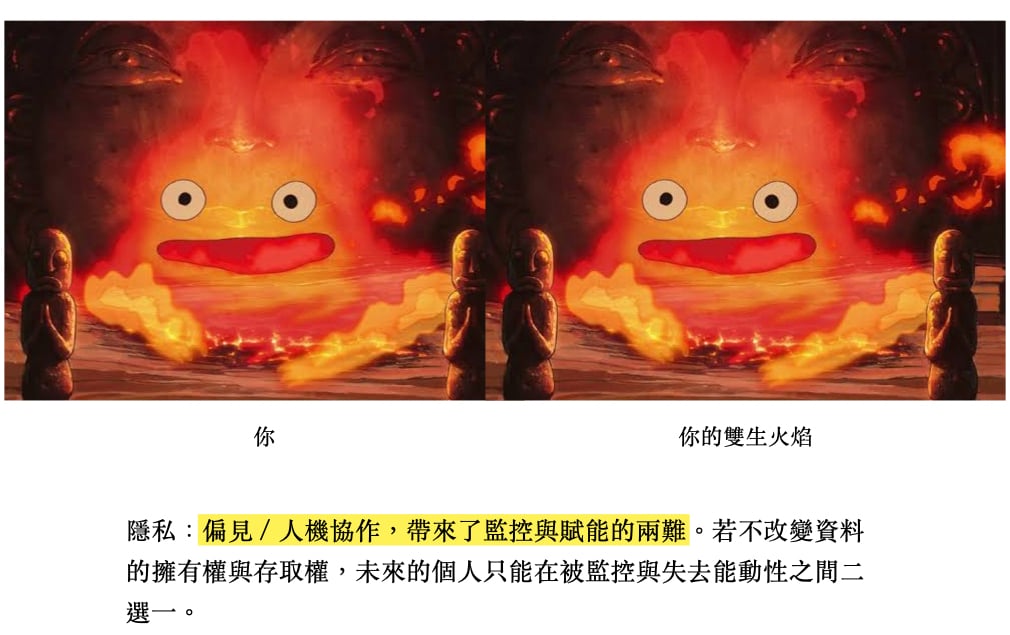

身心靈的世界有一個專有名詞,叫做「雙生火焰」。

雙生火焰的意思跟靈魂伴侶有點類似,

就是你會在世界上找到一個與你互補,但天造地設的一對。

我認為在未來,雙生火焰很有可能是人工智慧助理,

他了解你的一切,根據你的所見所聞,預判下一步。

但我必須在此提出,這樣的人機協作,對隱私帶來了巨大的挑戰。

因為AI越方便,表示他越能夠滲透你的隱私。

隱私肯定是未來分散式AI必須面對的大問題。

今天是點子松的論壇,點子松提倡推測設計,我們也想得遠一點。

4

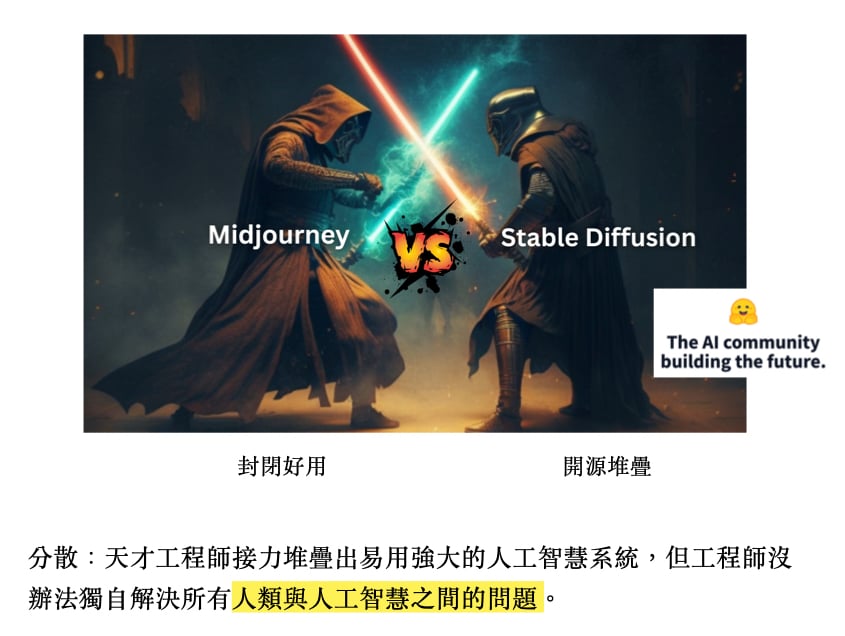

當然,分散式AI的時代還沒有到來,

現在我們在封閉與開源的分裂世界中。

以圖像式生成AI為例,

midjourney封閉好用,stable diffusion開源堆疊。

工程師可以設計出超棒的AI

但沒辦法獨自解決所有人類與人工智慧之間的問題。

5

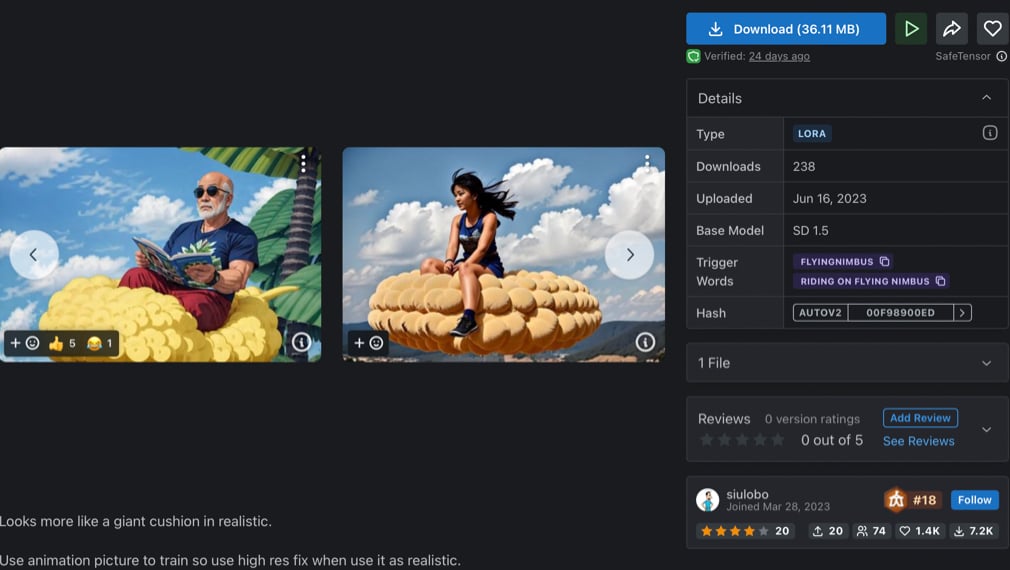

什麼是開源AI做得到,但封閉AI做不到的事情呢?

有沒有看過七龍珠,有一個網友太喜歡七龍珠了,

所以做了一個微調模型,

讓所有AI圖片,都可以生出七龍珠的觔斗雲。

然後他還放上網路上,讓其他的七龍珠愛好者也可以下載。

我們不可能消滅偏見,

就如同我們無法阻止一個人去喜歡七龍珠一樣,

我們更不可能阻止一個人去製造七龍珠觔斗雲的AI,

然後禁止他共享給其他同好。

因此多元宇宙,並非要消滅偏見,

而是讓更多人能夠創造多元異質的演算法,

貢獻在這個宇宙裡面。

6

但是我們只有一個宇宙。

AI 短期內正在對世界產生衝擊。

假的影像、假的聲音都非常容易製作。

唐鳳部長甚至餵了自己數年來的公開逐字稿,

生出一個自己的唐鳳語言模型。

在這樣的世界中,不實言論與deepfake將下降彼此之間的信任,

尤其是沒辦法實體面對面的彼此的信任。

跨國協作的習慣可能在短期之內造成影響。

當我們在面對COVID-19或其他需要跨國合作的問題時,

就有可能會延長解決問題的時間,

人類的福祉因此受到影響。

不過我們正在做一些真的唐鳳認證的合成唐鳳機器人,

派他出任務,等會兒如果有機會再與大家分享。

7

唐鳳部長在5月簽署了一個宣言,

聯合全世界的專家學者與倡議份子,

就是要將AI的風險,帶給更多人,

讓大家可以更快速地面對問題。

在這篇AI風險的聲明中,

這些專家認為人工智慧

應該跟COVID-19或核武戰爭同樣危險的存在。

但這次不一樣,AI不可能關回潘多拉的盒子。

我們也不可能用厚厚的水泥把他圍在核能發電廠裡面,

因為他已經出來了。

全世界的人都能夠發展他,

無論是好人,還是壞人。

8

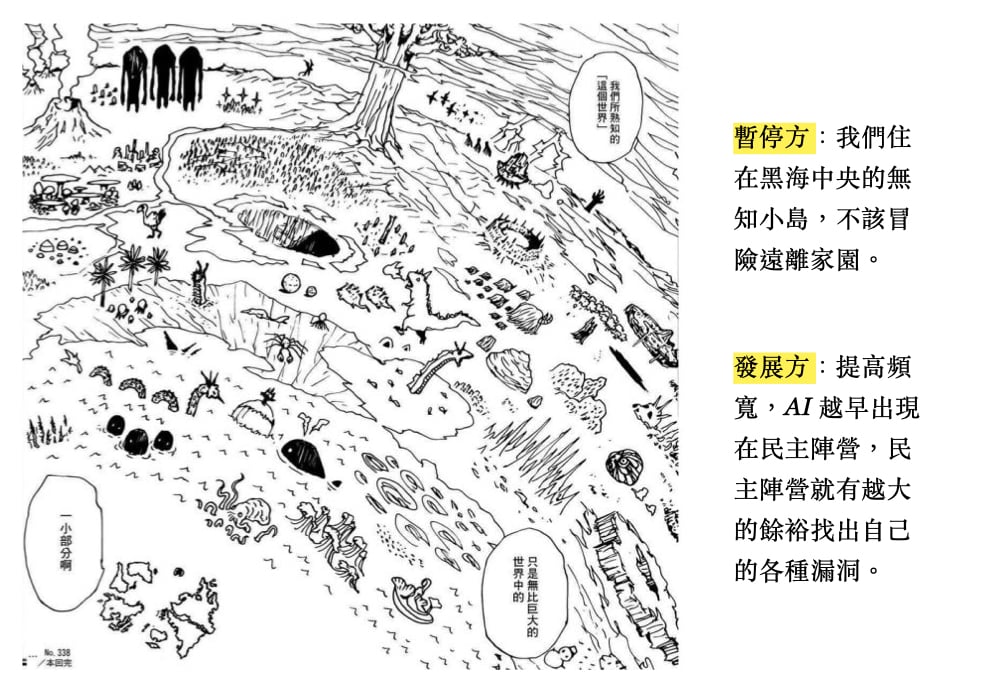

前幾個月有兩派人正在爭論,AI是否應該發展。

認為應該暫緩發展的人認為,

我們住在黑海中央的無知小島,不該冒險遠離家園。

支持發展的人認為,

我們應提高民主頻寬,

AI 越早出現在民主陣營,

民主陣營就有越大的餘裕找出自己的各種漏洞。。

這張圖片是我很喜歡的漫畫《獵人》的一張圖片,

左下角是人類世界,外面是無邊無涯的黑暗大陸。

漫畫裡面有一種恐怖的生物,叫做嵌合蟻,

相傳就是從黑暗大陸漂流進來。

這種螞蟻吃什麼就會生下什麼。

當他吃下人類,這些嵌合蟻便具有智力,甚至滅了兩個國家。

富堅義博的獵人告訴我們,即使我們不出去冒險,

危險也會自己走進來,所以我們不應該停止探索科技,

而是更加努力,去研究科技怎麼幫助民主社會,

這就是多元宇宙的精神。

9

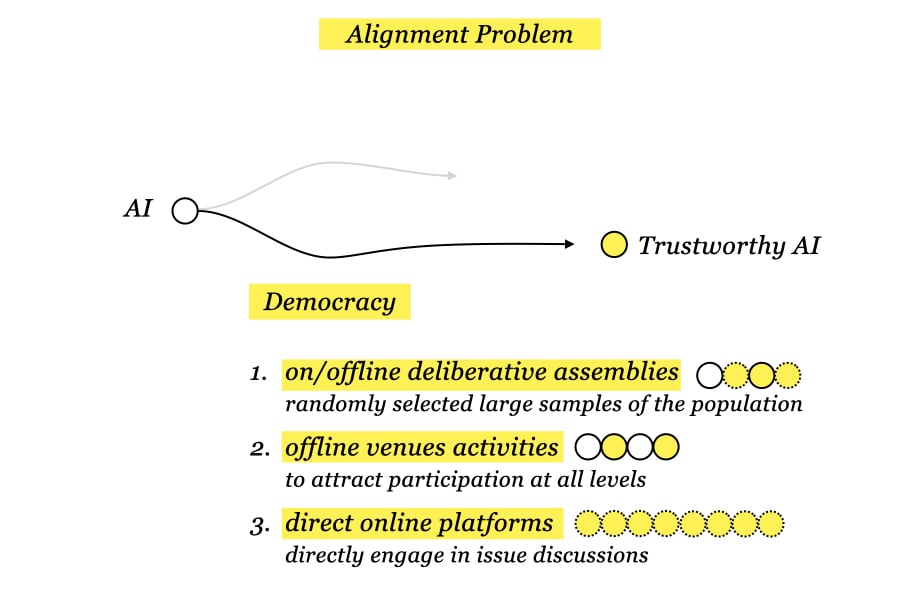

如何發展符合人類福祉的AI,這時候就必須討論一個新名詞,

叫做Alignment problem,對齊問題。

惟有與人類的價值觀對齊,AI才是可信賴的AI。

但對齊對齊,要跟哪一個人類的價值觀對齊?

是台灣人?中國人?還是美國人?

審議民主在這裡扮演了非常重要的角色,

我們可以從線上平台、努力抽樣全世界各地的人類,

或是順應當地的審議文化,藉由成千上萬人的想法,

匯集成多元異質的價值觀。

而這群價值觀,就叫做集體智慧。

10

而今年五月,數位部與一個組織合作,

這個組織就叫做集體智慧專案(Collective Intelligence Project, CIP)。

數位部參與CIP發起的對齊大會,

就是要完成對齊全人類價值的野望。

而第一批pilot計劃,便會在點子松裡面開始。

目前線上平台有polis,藉由是非題看出你的立場,

接下來也會串上talk to the city,與過去的集體意見對話。

接下來也有工作坊,邀請參與者實體審議,

這些結果都會公開出來,

讓OpenAI、Anthropic等發明各種語言模型的組織,可以參考。

11

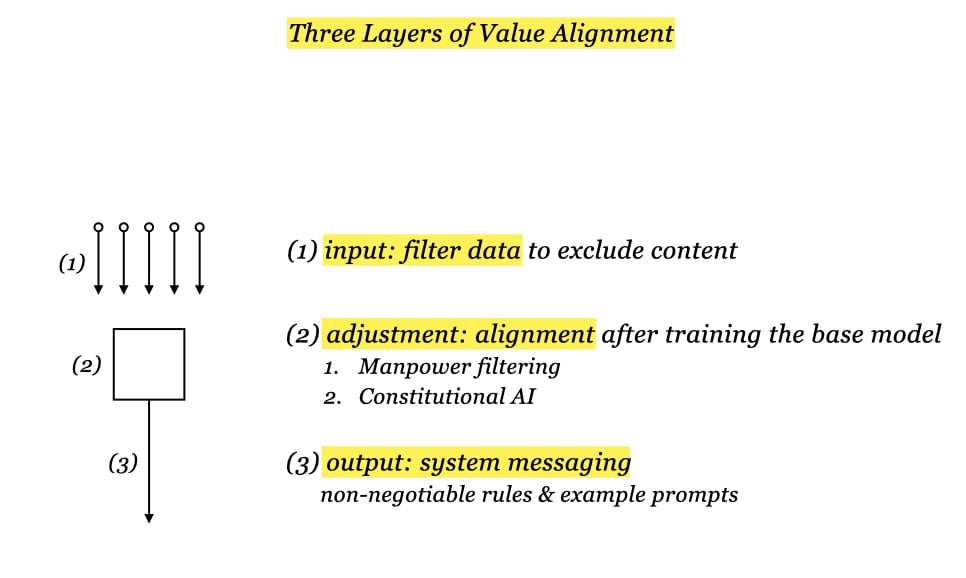

關於價值的對齊,這是唐鳳部長的理論,

他認為在AI製作的不同階段,

與人類價值對齊所需要做的功會不一樣。

比如在源頭階段,過濾資料很花成本,

在調整階段,調整基礎模型相對容易,

在這個階段中,我們可以使用人力來對齊,

也可以寫出一套憲法,來對齊。

最簡單的方式是在模型完成後,

在應用階段用系統訊息去強制阻擋不符合需求的成果。

12

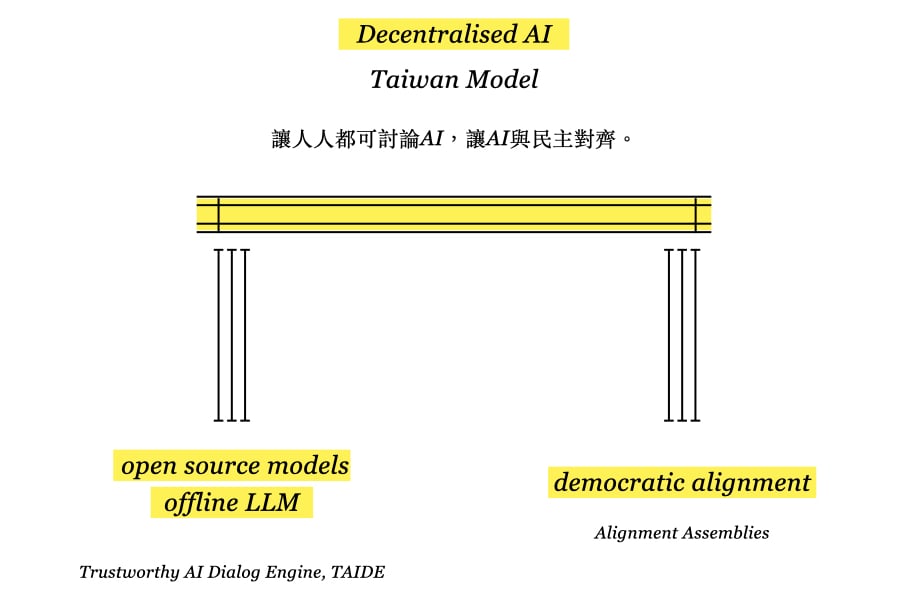

回到偏見,只要AI的架構還是中心化,

我們便不可能同時處理全球人類的不同偏見。

就跟人類永遠蓋不出巴別塔一樣。

在這個階段,有兩件事情值得我們去做。

13

第一時盡量發展分散式的AI模型,

而且要能夠不用接上網路使用,最好還是要開源的。

這方面國科會的TAIDE已經快要完成。

另一部分,便是讓AI民主化。

讓人人都可討論AI,讓AI與民主對齊。

14

這是第一次數位民主與集體智慧互相共創的場合,

而點子松將會成為這兩個美好概念的交集,

成為第一個共創的產物。

不留下任何一個人,

這感覺挺好的不是嗎?

15

時間還夠,分享兩個在AI民主化上面很棒的案例。

第一個是Masakhane,

Masakhane 是祖魯語的「我們一起建設」的意思

Masakhane 整合了非洲兩千多種語言。

用AI的方式保存未文字化語言,

這是大型語言模型現在做不到的事。

他獲得今年林茲電子藝術大獎數位人文獎的首獎。

16

第二個是Holly+,他做了一個AI平台,

讓所有人都能使用他的數位資料,包含影像、聲音等等。

他是很早期就在討論數位孿生與數位身體權概念的藝術家,

他獲得去年林茲STARTS的大獎。

17

最後,在AI的時代,我想引用Kevin Kelly在必然寫的話,

未來的我們因為大型語言模型,會被答案淹沒。

而此時,最好的問題沒有答案。

我們必須自己尋找。

18

最後的最後,想要與大家分享,

用集體智慧尊重差異,

用人工智慧善待自己。

我是多元宇宙科的豆泥,

謝謝大家。