【數位轉譯/博物館科技: 數位應用之共同元素與邏輯聯繫分析圖~從〖Draw to Art〗談起】

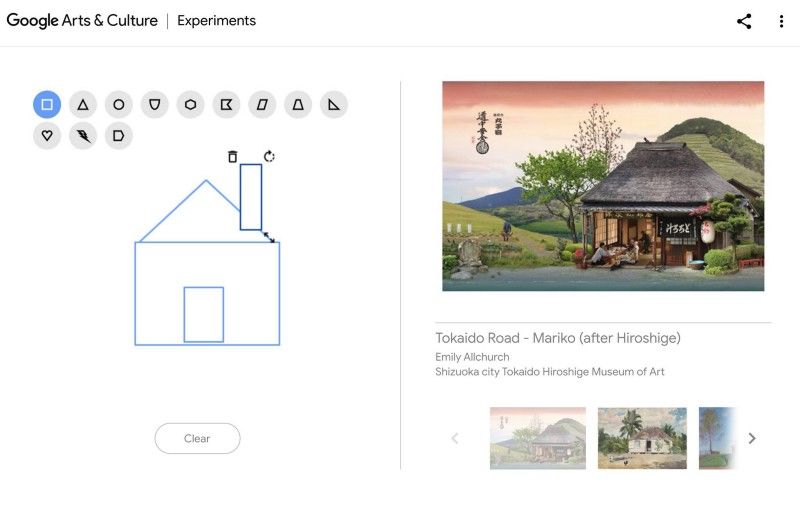

某天開完會後,讀著一篇之前存下的訪問稿:“THE FUTURE OF CURATIONSHIP WITH TECHNOLOGY /「策展技」佐科技之未來“(https://reurl.cc/e9keXQ) ,受訪者是倫敦市 The Serpentine Galleries的總監Hans Ulrich Obrist。由於他提到與Google合作的一款AR藝術創作,所以今天才又進Google Arts and Culture的【Experiments】專區去,結果就發現【Draw to Art】 已經正式發表。

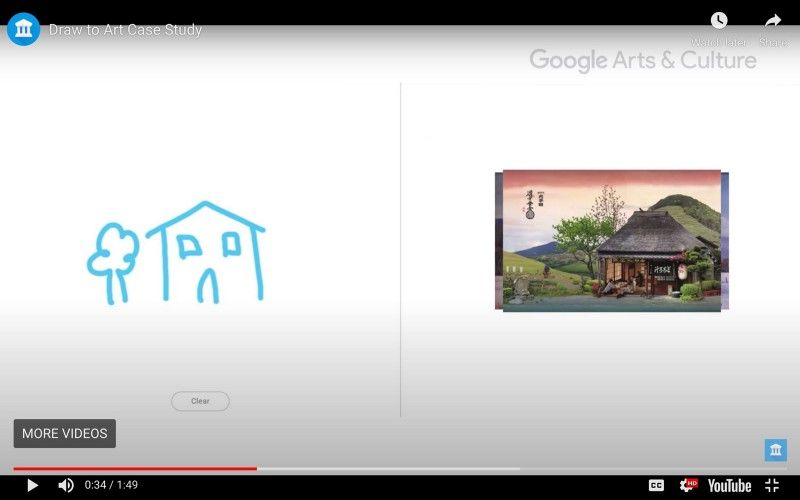

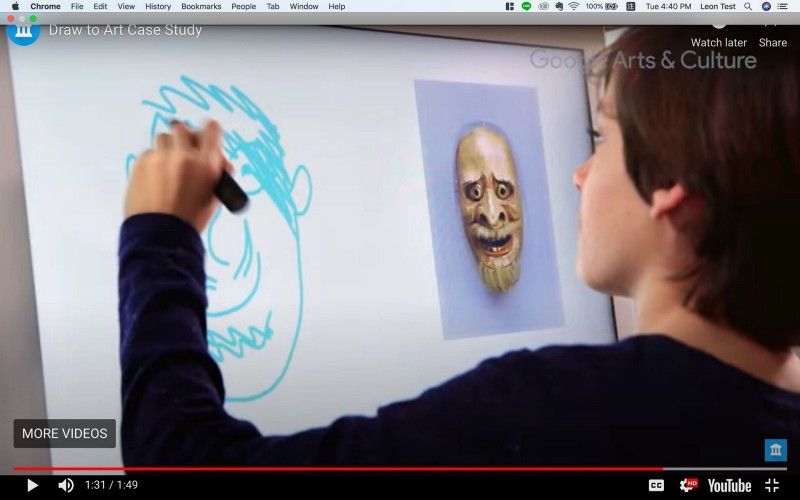

但這【Draw to Art】跟我在許多資料中看到,發表於2018年的版本有所不同。

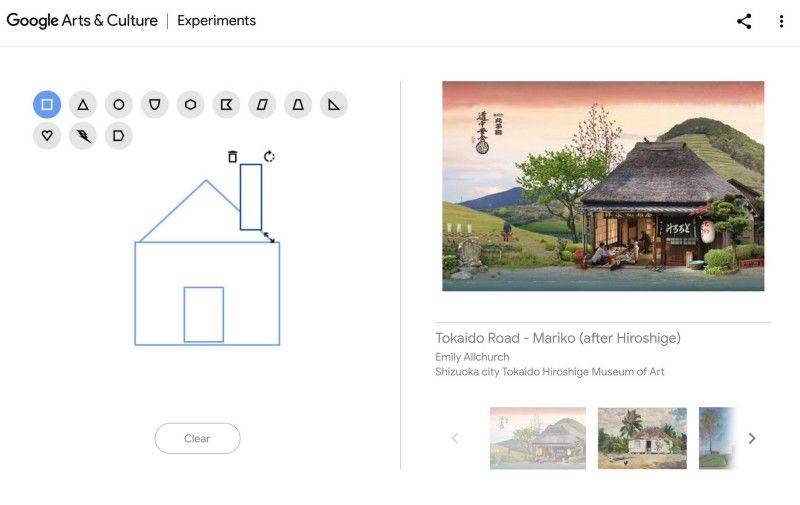

怎麼說呢?2018年版的【Draw to Art】是透過塗鴉畫圖即可搜尋數位典藏資料的實驗,基本上的就是「塗鴉繪圖+圖像辨識+標籤++數位典藏資料庫」的概念。但新版的【Draw to Art】並沒有提供塗鴉功能,而改以用幾何圖形的組合方式。

但撇開這部分「缺失」,基本上已能作為一項關聯技術的「完形」。

所謂的「關聯技術」是我整理六款Google Arts and Culture的【Experiments】專區中能夠示範「關鍵技術」一源多用之效益的數位應用,其核心技術就是「手繪圖之辨識+標籤」!六款分別是:

【AutoDraw】、【Quick, Draw!】、【Sketch-RNN Demo】【Scribbling Speech】、【Draw to Art】、【Story Speaker】等6款Google Experiments。先初步介紹如下:

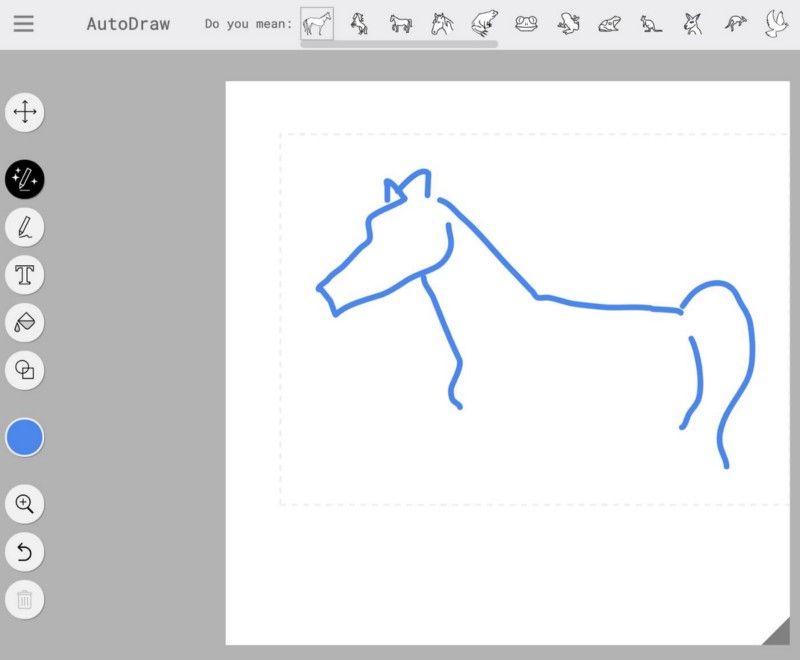

🚩 AutoDraw:

透過神經網絡猜測使用者繪製內容後,即在繪圖過程中,會根據所畫的造型線條去猜測並提供各式各樣的「圖示icon」在選項列上。而這樣的「繪製內容+神經網絡運算+圖像識別」的組合,會透過越多人參與(繪圖與選icon)得到持續的優化,也將更準確、更符需求。( Chrome experiment)(overview+launch experiment)(發表於2017.4)

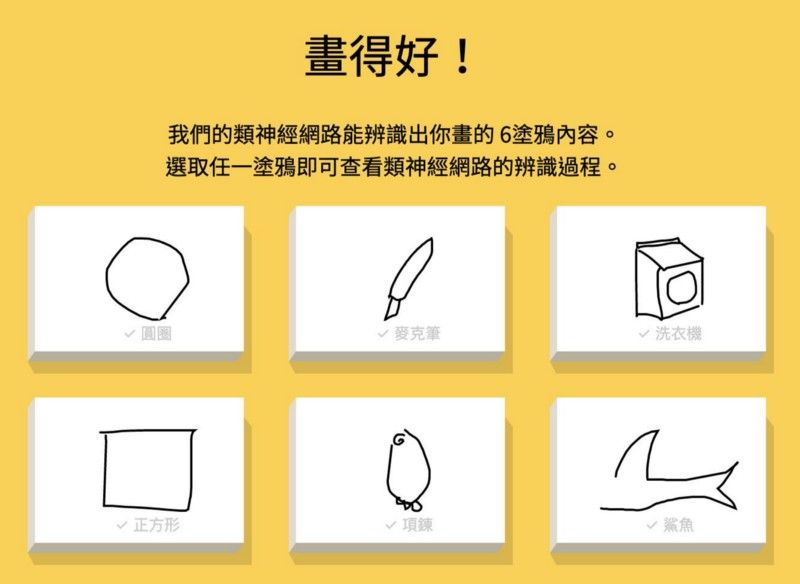

🚩Quick, Draw! :(https://experiments.withgoogle.com/quick-draw)

這是一個以機器學習所構建的遊戲,透過神經網絡試圖猜測使用者正在繪製什麼,類似於畫圖猜題的遊戲。進行網站開始後,或陸續收到應塗鴉內容的要求指令(例如:請畫出「曲棍球桿」),並且於20秒之內完成。神經網絡根據繪製筆畫進行辨識,可能判斷出或認不出與要求指令相符的圖像。判斷的依據當然也是與之前由使用者繪製並儲存的圖像資料庫為基礎,所進行的圖像辨識運算。( AI experiment)(overview+launch experiment)(發表於2017.5)

🚩 Sketch-RNN Demo:

此款應用目前已更新為【Magic Sketchpad】,一樣是透過累積的電繪塗鴉資料庫,使用者經選定想畫的圖像(例:貓、馬、車….)後,只消畫上幾筆,就會由AI根據資料庫圖像,讓使用者與神經網路運算共同完成個人專屬畫作,下圖即使個人與AI合作的綿羊圖。( AI experiment)(overview+launch experiment)( 發表於2017.6)

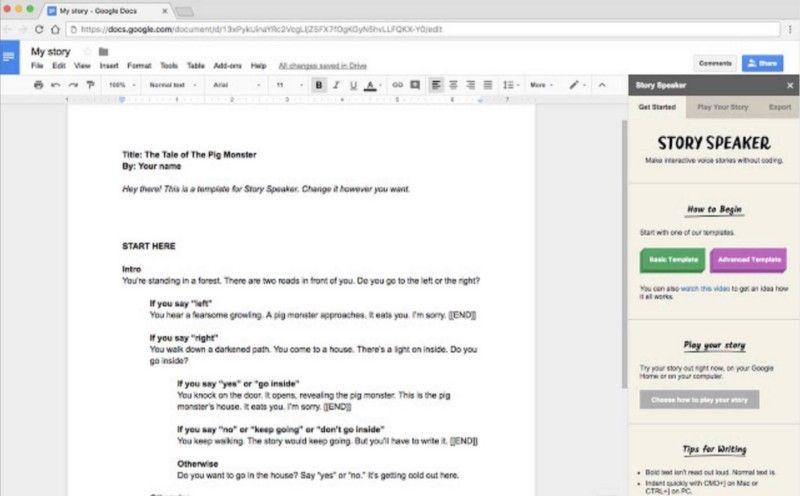

🚩 Story Speaker:

能將Google Doc網路文件編輯器上所寫的互動腳本(文字檔),透過Add-On加入Story Speaker應用程式,並語音播放與使用。這個已發布上架的研發成果必須搭配「Google Home智慧管家」 這款智慧語音服務裝置或「Google Assistant ~Allo語音助理」,具有互動功能可由閱聽者在許多段落自主選擇,而產生不同的劇情發展。而且這個互動腳本的編寫與應用,創作都不需要使用程式(Programing),即可在文件編輯上完成。( voice experiment)(overview+launch experiment)(2017.11)

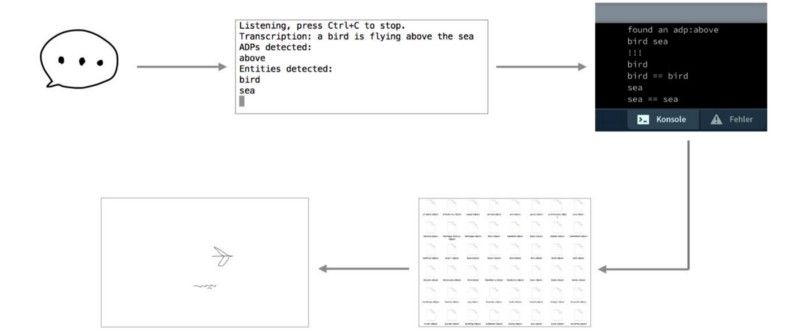

🚩Scribbling Speech:

使用者以語音描述想法、場景、或事物,此應用程式的機器學習和神經網絡功能就能即時在辨識語言後連結圖像,將話語轉換為動態視覺。(arts and culture experiment)(overview+launch experiment+get the code)(發表於2018.9)

🚩 Draw to Art:

透過塗鴉畫圖即可搜尋數位典藏資料的實驗,基本上的就是「圖繪+圖片辨識+AI搜尋+數位典藏資料庫」的概念。(arts and culture experiment)(overview only)(發表於2018.10)(2020.9新版)

為何這六款應該被串連,且作為「數位應用之共同元素與邏輯聯繫」之分析案例?

因為從Google 推出的AI 繪圖應用:AutoDraw(手繪找icon圖)與Quick Draw(繪圖答題遊戲)等均為具有圖像分析與機器學習技術的繪圖應用後,雖然它們在應用末端並未指向「數位典藏資料」,淡期透過神經運算所得繪圖辨識結果,已能連結到不斷儲存累積的塗鴉資料庫,基本上也是「圖庫概念」。因之,不論是Cleveland Museum of Arts的【 Line and Shape Interactive 】與Google 的【Draw to Art】這兩款「繪圖搜尋數位典藏資料」的應用都預示了此技術在未來一定可以進一步整合在數位典藏資料庫的創意搜尋、數位參與上。

據此,我也特別提出一源多用的「內核心」與「外創意」之關鍵觀念與技術。簡述如下:

🚩 聚焦溯源的「直探核心」:

必須直探那個串連起各個群組的核心(bullseye)。就數位科技應用來說,此核心(bullseye)不一定是特定技術、軟體、硬體,也能是個觀念/創意;但這個「觀念/創意」必定是在技術、軟體、硬體支援方能達成。

🚩系統向外的「創意發散」:

就如前述,數位科技具有「成本高」、「組合多」、「變化快」等內外部環境因素,為發揮最大效益,「一源多用」必須在各種支援的聯繫貫連下,在不同領域、功能、用途上進行「創意發散」。

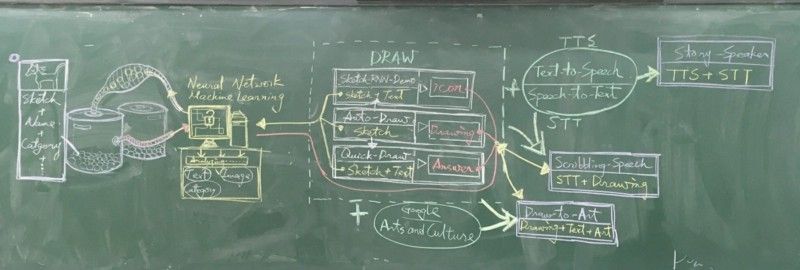

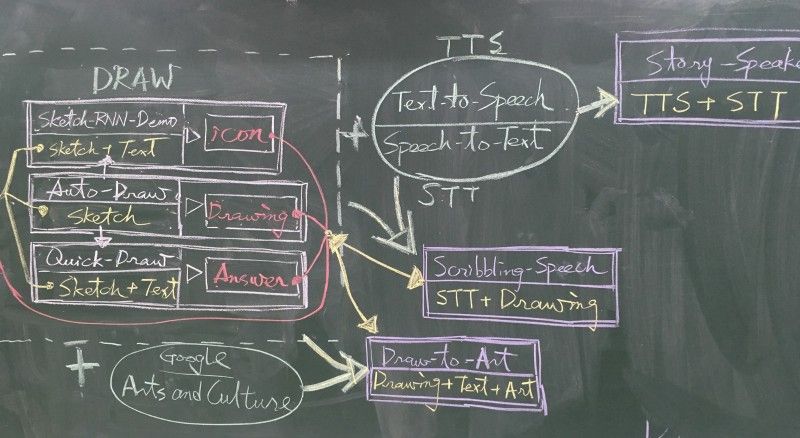

此外,我也將其間關係分析後,繪製整體架構的圖示,說明如下:

6款Google Experiments:【AutoDraw】、【Quick, Draw!】、【Sketch-RNN Demo】、【Scribbling Speech】、【Draw to Art】、【Story Speaker】,主要是發佈在2017~2018的區間,可粗略:

🚩 「Draw應用群組」:包括【AutoDraw】、【Quick, Draw!】、【Sketch-RNN Demo】。

🚩「複合應用群組」:主要是進一步應用像是Google Speech/Natural Language API的【Scribbling Speech】、【Draw to Art】、【Story Speaker】。

其創意關聯與發展流程就如附圖~「共同元素與邏輯聯繫之分析圖」。由左至右分別是「圖像資料庫」、「machine learning+neural network技術」、「draw應用群」、「複合應用群組」。

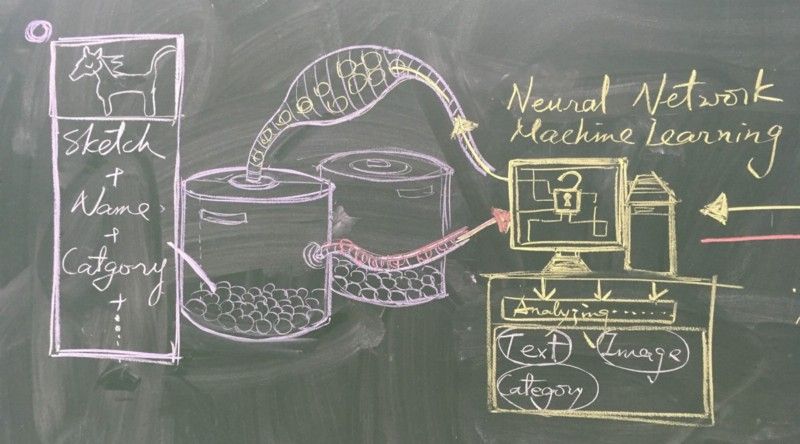

🚩 共同元素與邏輯聯繫之分析圖左半局部:

位於「共同元素與邏輯聯繫之分析圖」左側的就是「圖像資料/資料庫」更是此篇所介紹6款Google Experiments 的「內核心」。

「圖像資料/資料庫」是由使用者以線上/載具電繪介面(e-drawing interface)所繪製的具有「物件名稱(上圖例為『郵輪』)」+「線繪圖(sketch)」+「繪圖筆序(drawing sequence)」等等資訊的圖像檔。「它」所代表的「使用者繪圖記錄」、「使用者畫作成品」、「圖像資料」,也是進行AI應用時,使用機器學習、神經運算的資料基礎,input資料分析、output結果產出都得仰賴這些資料,以及不斷的優化與修正。

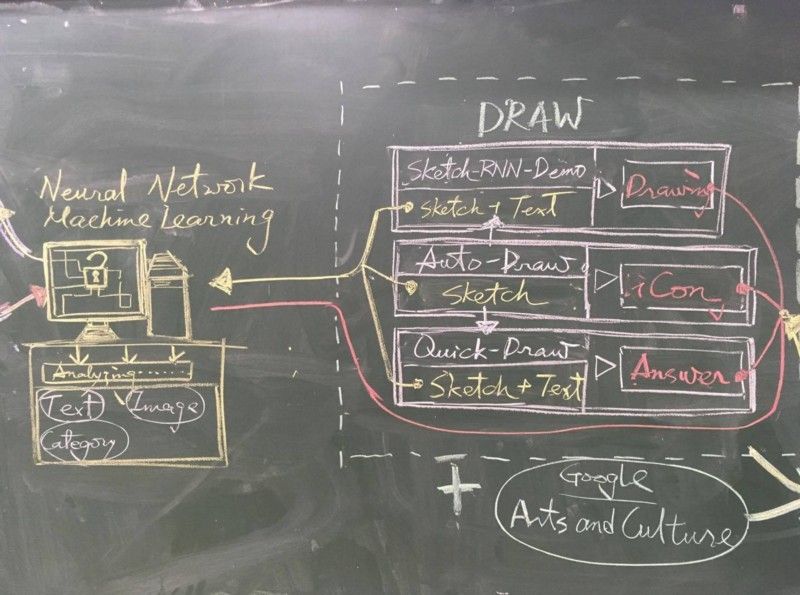

🚩共同元素與邏輯聯繫之分析圖中間:

由於導入群眾協作的數位參與應用所期待的是多元開放式成果的「同源殊徑」(希望匯聚群眾多元創意的「分進合擊式想像」),或者是Aaron Koblin所追求的具有獨特性的量產商品(one of a kind product)。2017 年所發佈的【Sketch-RNN Demo】、【AutoDraw】、【Quick, Draw!】等3款,就技術創意關聯來說,彼此間是以【AutoDraw】(sketch)為核心原型,【Sketch-RNN Demo】與【Quick, Draw!】則再進一步以「塗繪+名稱 sketch+text」的組合,而有新的創意關聯應用。

🚩 共同元素與邏輯聯繫之分析圖右半部:

2018 年所發佈的【Scribbling Speech】、【Draw to Art】、【Story Speaker】等3款進一步應用Google Speech/Natural Language API、Google Digital Archive的「複合應用群組」,則是在2017年的「Draw應用群」的基礎上,複合更多的數位技術,達成更多的實務應用,無論是「TTS/STT+Draw」的複合版【Scribbling Speech】去創意地整合語音技術讓「圖像資料/資料庫」能夠即時產出對應的「動態圖繪」;或者是「Google Digital Archive+Draw」的複合版【Draw to Art】去創意地整合數位典藏資料庫搜尋技術,讓「圖像資料/資料庫」成為圖像搜尋資料庫能夠即時輸出對應的「數位典藏資料」。

❤️小結:

公私立單位的數位應用軟體之開發成本均高,因此不論是技術、用途、內容都應該在委託與製作時一併考慮更多元的用途,以使技術與資源能夠不斷累積。

此篇系統化地透過「內核心」+「外創意」的概念去進行「技術與創意有機組合」的範例研究,且初步証明了創意發想與應用能力仍必須有建構在系統性組合上。因之本篇從Google Experiments 近200多款應用程式中,特別揀選6款應用,試圖在「一源多用」的創意發想邏輯上,針對單項數位科技/創意的應用上進行分析,理解如何有系統地進行跨域(實際場域、專業領域)、延伸(技術模組化/加值型的應用)的創發,然後務實地進行「(內)核心」到「(外)創意」架構的「共同元素與邏輯聯繫之分析」。

Like my work? Don't forget to support and clap, let me know that you are with me on the road of creation. Keep this enthusiasm together!