利用集体心智创作的机器与艺术家

高中时代很爱一部科幻小说,由星云、雨果、坎伯三大奖得主罗伯特.索耶(Robert J. Sawyer)撰写,叫做《 WWW.苏醒》(www:wake),故事大概是一名聪慧的盲眼女孩自从装上电子眼之后,因为某些bug 见证了网路心灵的诞生,网路心灵因主角的电子眼而有了与世界互动的机会...。

时间快转十年来到此时此刻,OpenAI 与Google 在这几年间推出了革命性的人工智慧工具,包括AlphaGo(自动博弈)、GPT-3(语言生成)、AlphaFold(蛋白质预测),每一个都让我觉得世界在光速进化。

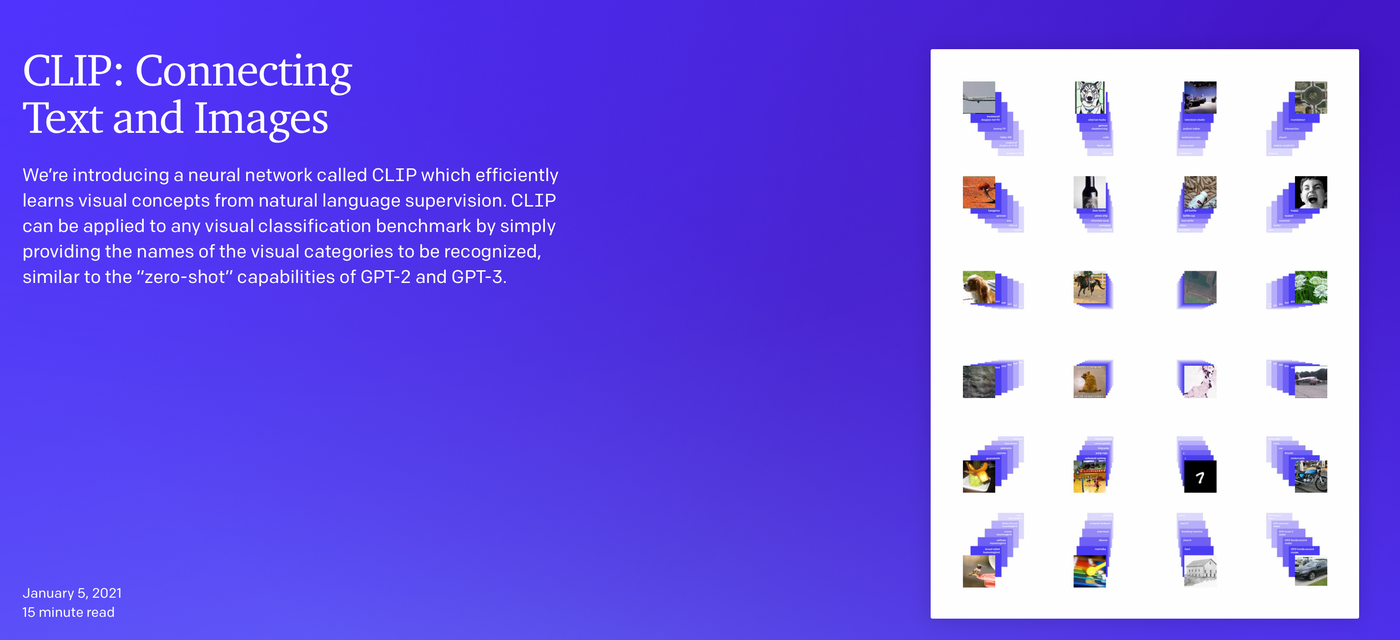

今年一月,OpenAI 将魔爪伸向了图像生成领域,Dall-E(达利)系统可以藉由输入语句做出变幻无穷的图片(Text-to-Image),其中的核心灵魂— 文字图片配对引擎CLIP (Contractive Language-Image Pre-Training)是开源软体,这几个月图像演算界像是著了魔般突飞猛进,演化出看次无穷无尽的新玩法。

就在上周Pixray 网站出现,让一般人可以输入语句,换取由AI 工具生成的魔幻图片,甚至可以一键铸造NFT。两周前我分享这个应用的文章,竟然获得八百多个分享,让我在讶异之余,深深觉得新的时代已经到来。

不知不觉中,集体共识的时代已经来临,所有人都中了网际网路的瞳术。

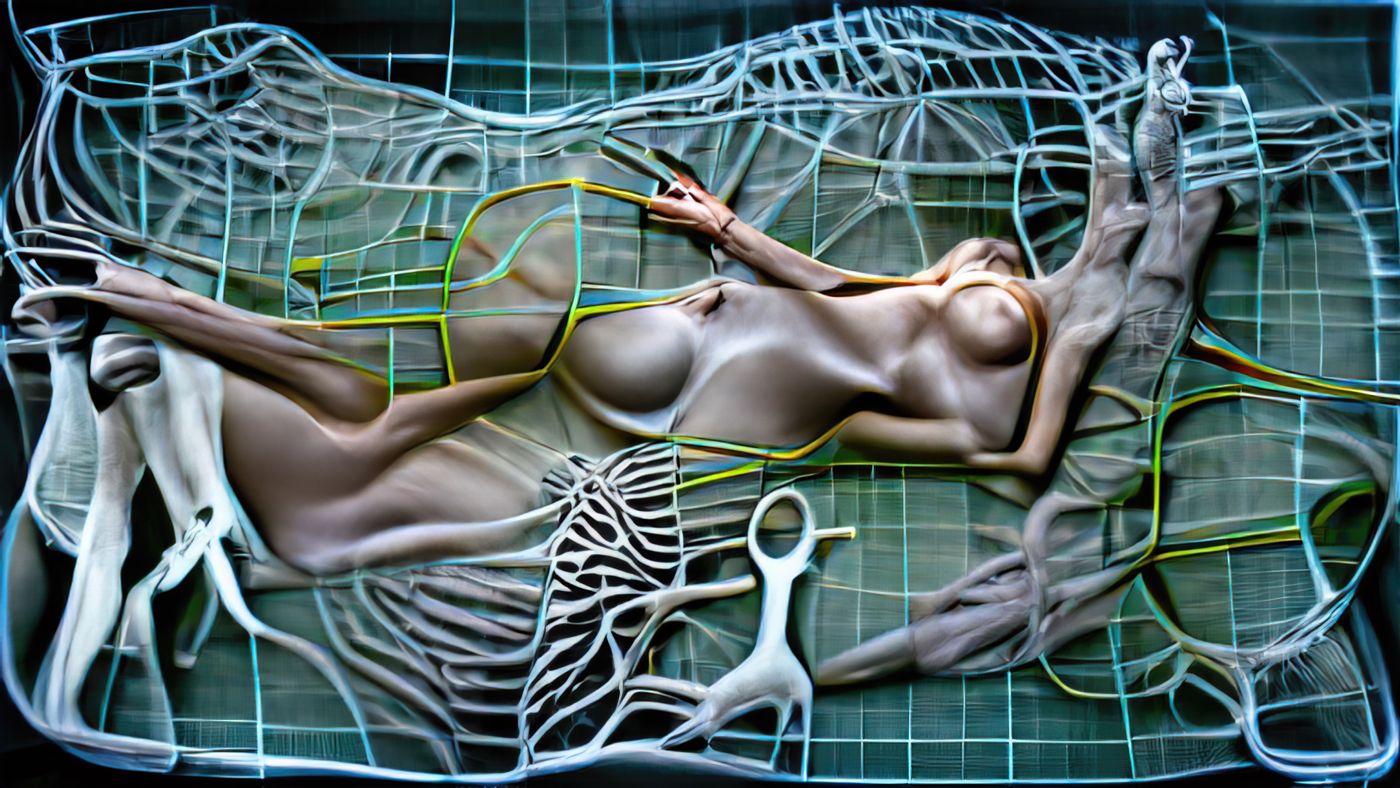

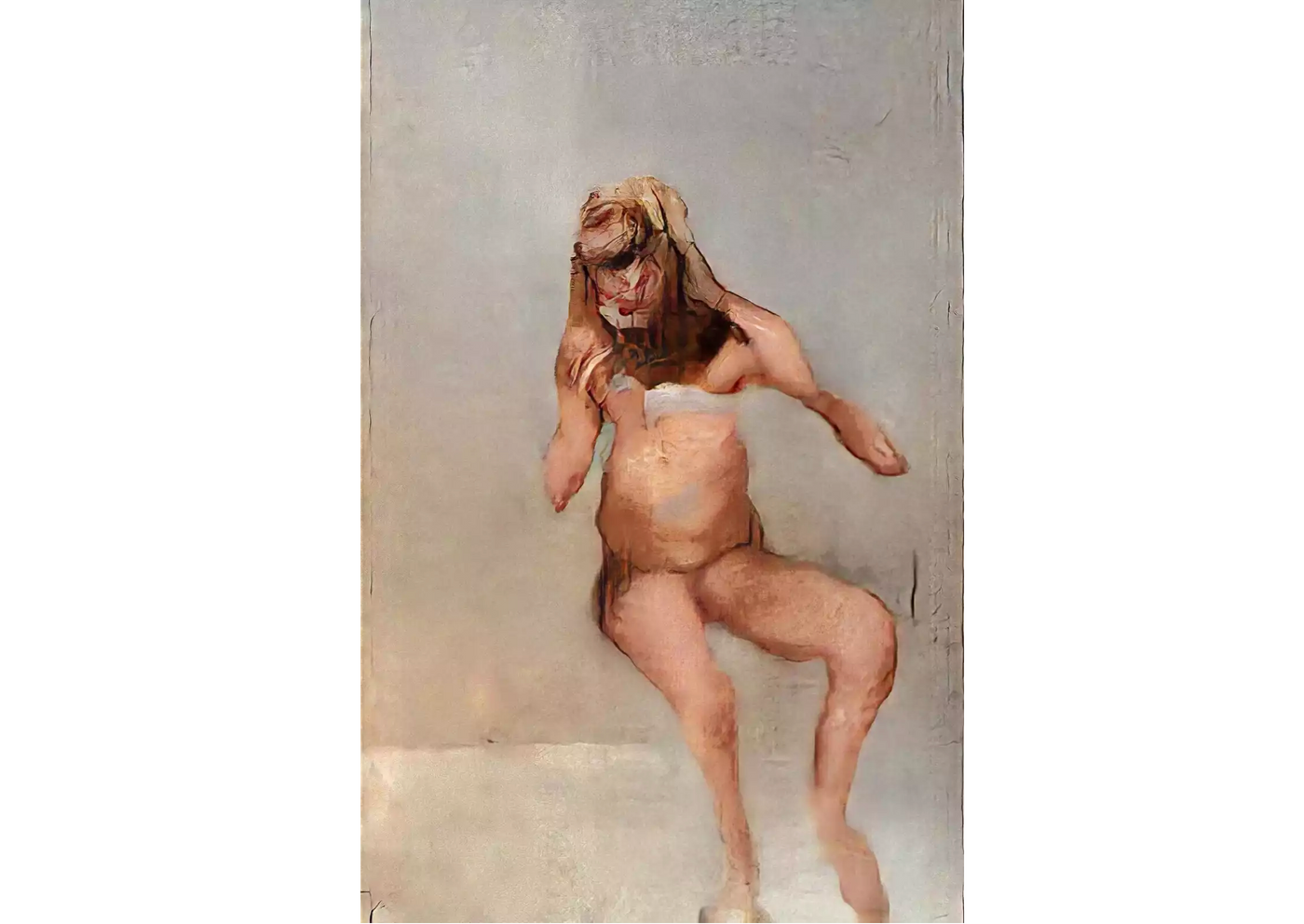

我把Pixray 传给艺术家朋友张明曜看,他仿佛着了魔,没日没夜的算图,藉由调整字句与骰图,让图片展现其意图,目前应该已算超过一万张图。踩在其他图片的尸体上,目前有九张图诞生,构成了系列作《创世纪Genesis》,这几天瞬间热销一空。

今天不讲NFT 销售策略或是图像美学,纯讨论什么是从网际网路诞生的集体共识;与张明曜的行为,是否是一种集体心智共同创作。

其实AI 艺术已不是新鲜事,AI 艺术先驱Mario Klingemann 于2018 年获得〈流明奖〉(Lumen Prize),其作品〈屠夫之子〉便是使用GAN(Generative Adversarial Network, 生成式对抗网络)训练制作;之前提到由Memo Akten 创作的分散式意识(章鱼),也是以GAN 进行创作。台湾艺术家赖宗昀的〈Ancestor〉应也是类似的创作方式。

“How will we be able to make a living if machines take over our creative jobs?”

- Mario Klingemann

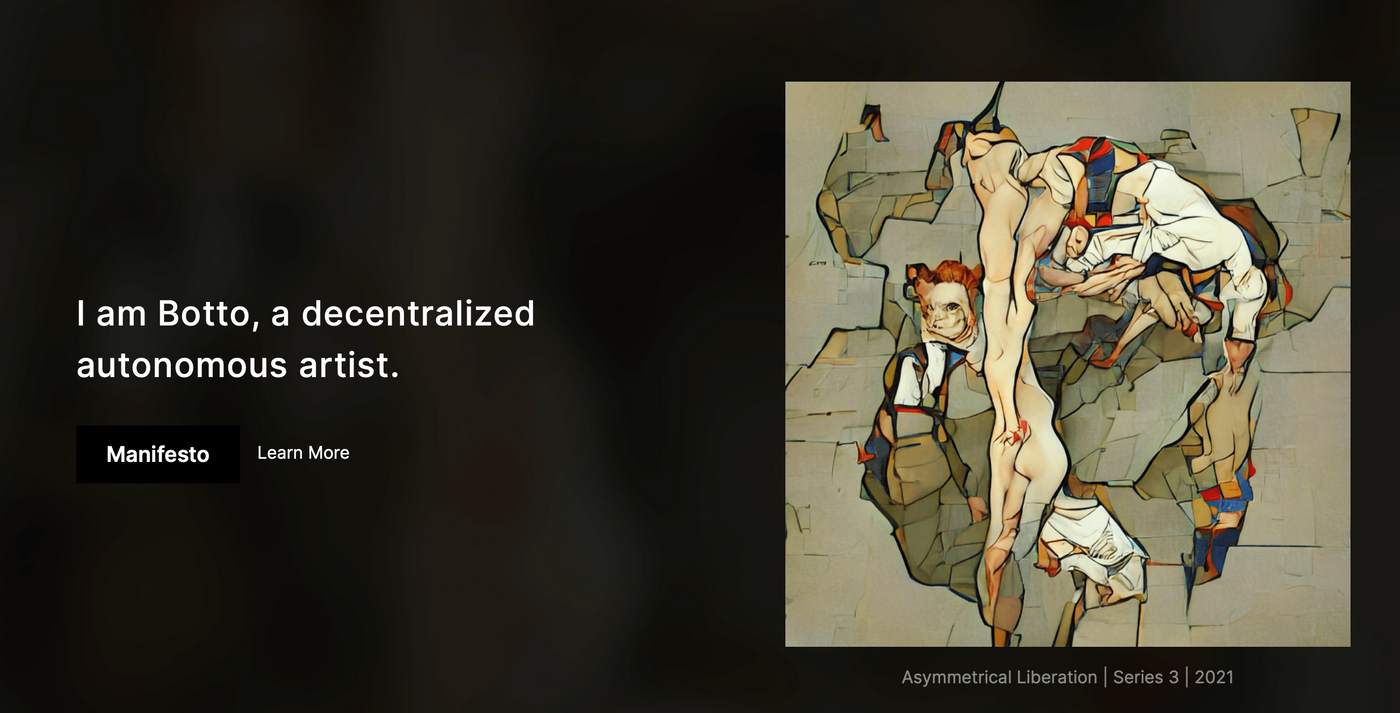

就在十月底,Mario Klingemann 打造了一名AI 机器艺术家Botto ,与其背后支撑他的代币经济$Botto,其背后的创作原理与文前提到的Pixrary 相同,这部机器会定时接受社群提出的文字语句进行创作,其作品的交易量已经超过三千三百万台币。整个策略与行动发人省思,作品也很美。

〈张明曜x Pixray〉与〈Botto〉这两个案例让我久久不能自已,我感到空前的震撼与深刻,有一种伸手碰触到繁星的感觉。

我仔细穷究这个震撼源自何处,发现其原因不是AI 会创作、会自动演化;而是因为这两台机器背后使用的核心灵魂— 演算法CLIP。

这个演算法的粮食,来自全人类的网路足迹。

忝为一名就读AI 相关研究所的菜鸟硕士生,我对程式码与方法论没那么熟稔,过程中若有疏漏请多指正。

先讲结论,CLIP 在诞生时不是经过事先准备好的资料集训练的,而是使用网路上能找到的一切具有文字标签的图片来训练,因此我们很难去预判CLIP 到底学到了什么。使用CLIP 时,不需要再次准备图片资料集去做训练,这个方式称为Zero-shot learning。

网路上一切有文字解释之图片,是谁的解释?解释权在谁手上?

不是科学家的解释、不是工读生的解释,是「我们」的解释。

更进一步来说,是自古以来网路使用者的解释。

我们想到什么,记下什么,人工智慧就会去消化它,学习它,成为一部没有灵魂,但有渊博知识的艺术家。人类藉由念出一段咒语来召唤人工智慧,他生出一件作品给你,请问这件作品是由谁创作的呢?念咒者、人工智慧、还是全人类?

打个比方,当你在Pixray 写下艾菲尔铁塔(Eiffel Tower)时,机器吐出来的图片是一个铁制尖塔,不是从艾菲尔铁塔底下往上看的样子,也不是站在塔顶往外看的样子,为什么呢?因为全人类都一致认为,艾菲尔铁塔便应该一幢从远方凝视的尖塔。

艾菲尔铁塔的符号非常明确,大家的心像大致上相同。

这就是集体心智,AI 演算法夺去了这个心智,展现给大家看。

那张明曜与$Botto 持有者做了什么?他们成为应用新工具的创作者。

Prompt Engineering (中文不确定怎么翻译,我先称之为引导工程)是这种创作方式的名称,藉由不同词汇的堆叠,仿佛画笔不断将颜料堆叠在画布上。

这可不是一件容易的事,颜料有色调、运笔有技法、构图有各种消失法(拿出我国中美术班的知识...),Prompt Engineering 必须逆向工程出AI 吐哺集体心智诞生的新词汇,名词、形容词、动词、介系词、方向导引等等。

但同一个句子,机器会骰出不同的图片,因为训练集与演算法特性使然。

多么诗意的创作过程呀。

因为人工智慧进步,今天的人类已可以使用诗句来进行图像创作。

这是我感到震撼的原因。

这是全新的画布与画笔,折射出我们内心习以为成的事物。

(文章到此已经结束,如果你对原理有兴趣,可以继续往下看。)

摘录张明曜作品叙述

「藉由人工智能生成图像的技术日益成熟,生成艺术似乎只剩下两种状况:藉由编程来影响机器的运算逻辑,或是将创作的意识全权交付给机器。无论何者,图像的创造性似乎已不再由人所掌握。那么,透过与机器不断协商的方式,取回一部分的创造性,是否能称得上是生成艺术的文艺复兴呢?」

「《Genesis》这系列作品,使用Pixray的图象生成网站,不停修正字串与机器进行协商,且不使用任何指令与语法,来生成符合期望的图象。作品名除了指向生成艺术外,亦连结至米开朗基罗的《创世纪》,来谈论与机器携手之创造可能性,思考在放弃编程却不舍弃图象创作意识的状况下的「人本」精神。 」

VQGAN+CLIP 演算法原理

回过头来讲Pixray 的演算法组合,工程师Dribnet 融合了Perception Engines、VQGAN+CLIP、Sampling Generative Networks,打造Pixray 创作平台,大家有兴趣可以上去玩玩看,简单又好玩。今天只稍微解释什么是VQGAN+CLIP。

上文提到CLIP 于今年一月由OpenAI 提出, 更新的融合技术CLIP guided GAN imagery 于今年四月由Ryan Murdoch 与Katherine Crowson 提出。十一月时已经可以看到应用其技术的GUI (图像式介面,就可你不用开终端机就能玩的服务)民间使用平台,实在令我讶异科技进步之神速,果然开源精神是一条最有效率的道路。

简单来讲, VQGAN+CLIP 是一个文字转图片的工具(text-to-image),只要设定文本导引(Text prompt),它就会给你图片。这个工具已经替AI 创作工具(Creative AI)创造新浪潮。

VQGAN 与CLIP 分别是两个神经网路架构, VQGAN 全名为Vector Quantized Generative Adversarial Network(量子化向量生成式对抗网络),使用卷积神经网络加上知名的文字演算法(Transformer, BERT & GPT的爸爸),白话一点来讲它读取文字,产出图片。 CLIP 全名为Contrastive Language-Image Pre-Training (预先训练对照式语言图形演算法),它判断哪一张图片最匹配文字叙述。 OpenAI 同一个时间推出的Dall-E 达利系统,是采用数亿张已知的图片资料库来训练,而CLIP 本身采用未知的网路图片进行训练。

创作者提出文字,VQGAN 产出图片,CLIP 告诉VQGAN 图片对不对,对错的准则由网路全人类的结晶决定,以此方式反覆迭代到创作者说停为止。

我认为这个工具将产生巨大的创作能量,现在只是一个开头而已。

尽我所能提出解释,以下索引欢迎参考。

喜欢我的作品吗?别忘了给予支持与赞赏,让我知道在创作的路上有你陪伴,一起延续这份热忱!

- 来自作者

- 相关推荐