一直是這樣我的血脈裡沒有正經

我是人,不是机器的薪火

「AI 教父」Geoffrey Hinton 高调离开Google,因对人工智慧抱有伦理顾虑

查了一下Geoffrey Hinton 是何许人:以推广AI 为毕生志业的先锋者,2012 年开发出基于神经网路(neural network)技术的图形辨识系统,成为当今AI 的重要基础。

这句话另一层意思是,不过才十年,AI 成熟度已突飞猛进,时下当红的生成式AI(generative AI)更让「取代人类」的警语不再是警语。无怪乎伦理议题自然而然成为AI 所衍生的炎上话题,但同时也别忽略了我之前提过的隐私与智财权问题,那亦属道德范畴。

还有一点。文中说「 Hinton 认为AI 在过去五年里发展神速,而未来五年可能发生的事情将是『非常可怕』的。不过Google 首席科学家Jeff Dean 强调他们仍将致力于采取『负责人的方法』,并对『新出现的风险』保持警惕。 」

【题外话】什么叫「负责人的方法」?查了纽约时报原文,这句是"responsible approach to AI",也就是「对AI 负责任的态度」。这翻译也太烂。不过我猜是typo,把「任」打成「人」。

可是Google 从来都是说得比做的多啊,他们会把伦理道德置于技术研发之上才有鬼,连"Don't be evil" 的精神口号都在2018 年被移除了。这桩著名事件发生于「 Maven 计画」所引发的争议最高峰时,毕竟与美国国防部合作打造军事用途技术这种事情实在很反道德,尤其Google 所在的矽谷,风向往哪儿吹人尽皆知。

有趣的是,许多包含资讯技术在内的新科技,都是由军方主导开发或赞助,最有名者即为Internet 的鼻祖ARPANET 。

但身为民间企业,你可以有你的道德价值,你的员工也是。

譬如Geoffrey Hinton 过去就曾经辞掉卡内基梅隆大学的研究工作而转赴加拿大,正因为美国许多AI 计画都是五角大厦出钱的。有此前例,他现在辞掉Goolge 的官位也不令人太意外。

不愿意跟军事扯上关系,其实是许多公司所重视的伦理价值。像是以儿童为主要市场的乐高,就绝对不出现代军事武器的产品。可能有人看过军武积木(到处都买得到),但那其实都不是乐高原厂的。乐高的砖块本身专利早过期,任何人都可以推出他的模型盒组(只是原厂产品仍有IP,他人敢照抄就是侵权),但那都不是原厂的产品。

我现在服务的公司也是,上次我们部门规划team building 的outing 主题,大家投票决定去打雷射枪——还不是漆弹唷——却被总公司活动策划部门否决,因为那会「助长冲突」、「破坏情感」。后来我们只好改成去打保龄球,这公司就同意了。是说打保龄球组队互相竞争就不会「破坏情感」喔?

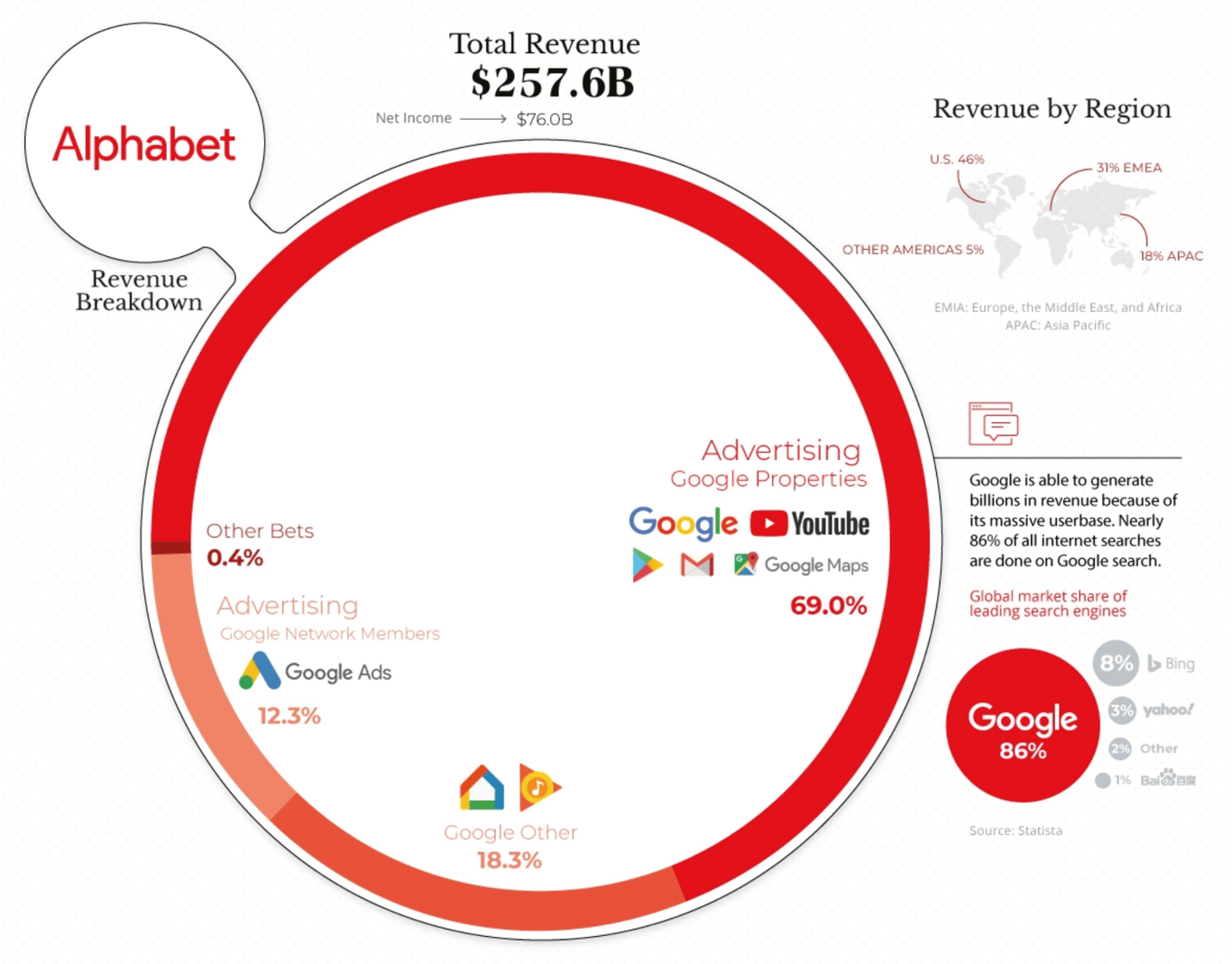

无论如何,身为民间企业,可以有所为有所不为。可若当你的营收超过八成来自广告相关事业,你说你不会出卖使用者隐私,叫我怎么相信你?你可以卖我的个资去做广告,难道就不会将我出卖给政府?去让我变成机器学习资料集中的一部分,还反过头来取代我、危害我、笑我不懂尊重你?

身为二十多年资讯业老屁股的我,从来认为科技可以带领人类文明的前进,其价值不该被保守者斲丧。但科技源之于人也用之于人,「如何保护人」才是它的「人赋使命」,这道理在「 机器人三大法则」被提出的八十年后愈发明光鋥亮。不要真搞到需要能够区分真人和仿生人的「孚卡测试」(Voight-Kampff Test)出来才知道觉悟,艾希莫夫和PKD 早就警告我们过。

我是人,不是机器的薪火。

喜欢我的文章吗?

别忘了给点支持与赞赏,让我知道创作的路上有你陪伴。

发布评论…