【數位科技/博物館科技系列:智慧鏡頭的IoE (Interfaciality of Everythings 萬物介面性)論】

一、以IoE為名的概念

很明顯的,此篇專文的標題名稱是借用了大家(泛指大科國中老師們)所熟悉的IoT物聯網、AIoT智物聯網、與IoE萬物聯網,IoT物聯網基本上是訴求「將實體對象連結到網誌網路」;而IoE萬物聯網雖然有時有用作IoT的中文譯名,但主要是以雲端技術物物相連,使物聯網在物理上的分散,透過運算與管理,而終將人、資料、流程、對象匯集。

而此篇要談的則是的「IoE (Interfaciality of Everythings) 萬物介面性」,我著眼的是在近來仔細地觀察目前擴增/混合實境AR與MR軟硬體的發展後(註 1),先不管原本專擅為實物連動而呈現虛像資訊的AR應用竟也在近來景深與人像偵測技術的進化後,逐漸趨近甚至涵括在實境空間中具有擬真之虛實整合效果的MR,而使AR與MR更難區分的這個「定義」前提(註2),我認為當這類技術不斷進化,且讓虛擬物件能在實境空間中有更真實的成像效果後,我們周遭的空間、物件、資訊(圖文)都將透過這些技術,而具有介面性(interfaciality),甚至使泛知識時代不僅是出現於數位世界的議題,也將會是真實空間的課題。因為在機器視覺(註 3)中萬物可視,遂可據以實現檢視、判別、辨識、測量、連結等數位資料服務功能。間單的說,我認為「IoE (Interfaciality of Everythings) 萬物介面性」也可以說是「介面萬物論」,因為未來能聯通基本與深度資訊成像的「介面」,不會只能是數位形式,也能是實體物件與空間。而熟悉使用AR的朋友就懂,AR+GPS技術的結合,使能在特定的空間位置就能出現虛擬的「指標」、「按鈕」、「寶可夢」… ;AR+marker的設定,使特定物件與圖片上也能出現各種虛擬物象與資訊。

但上面都是得去製作發布AR或MR的數位應用才能「為特定物件」「在特定空間」「用特定圖標」去產生虛擬物象與資料,但下面要介紹的,也是讓我有這篇專文依憑之靈感的Google Lens (智慧鏡頭搜尋),就可辨識搜雲萬物,讓萬物成為介面。

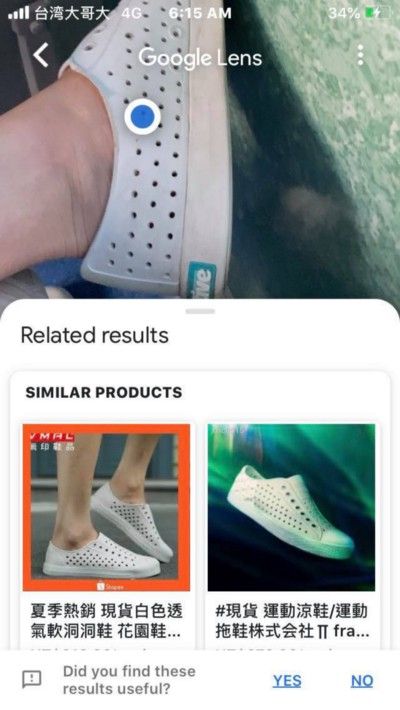

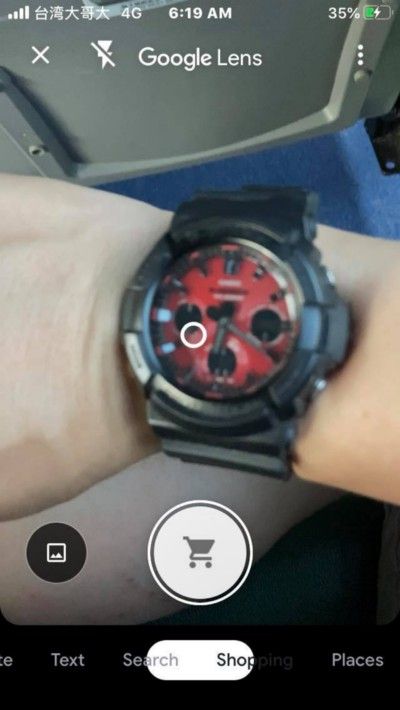

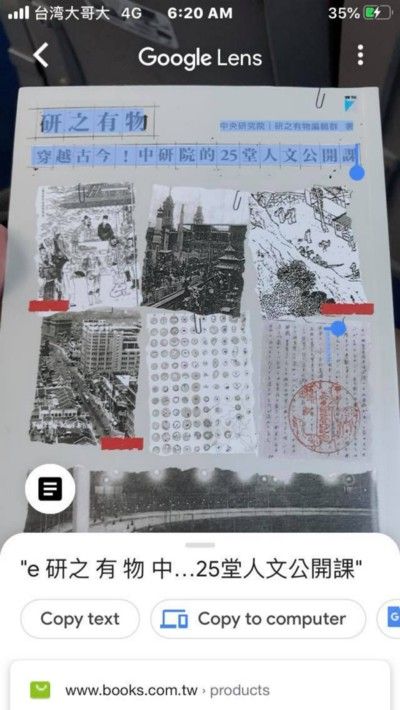

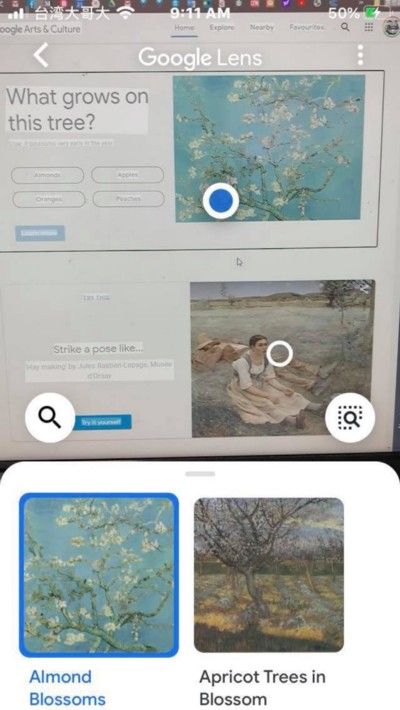

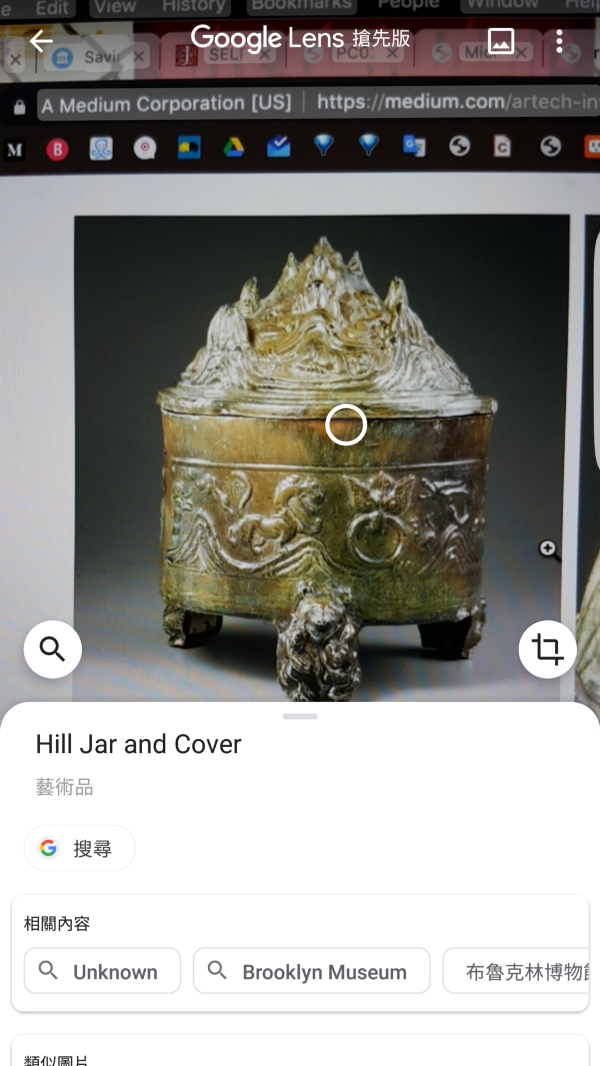

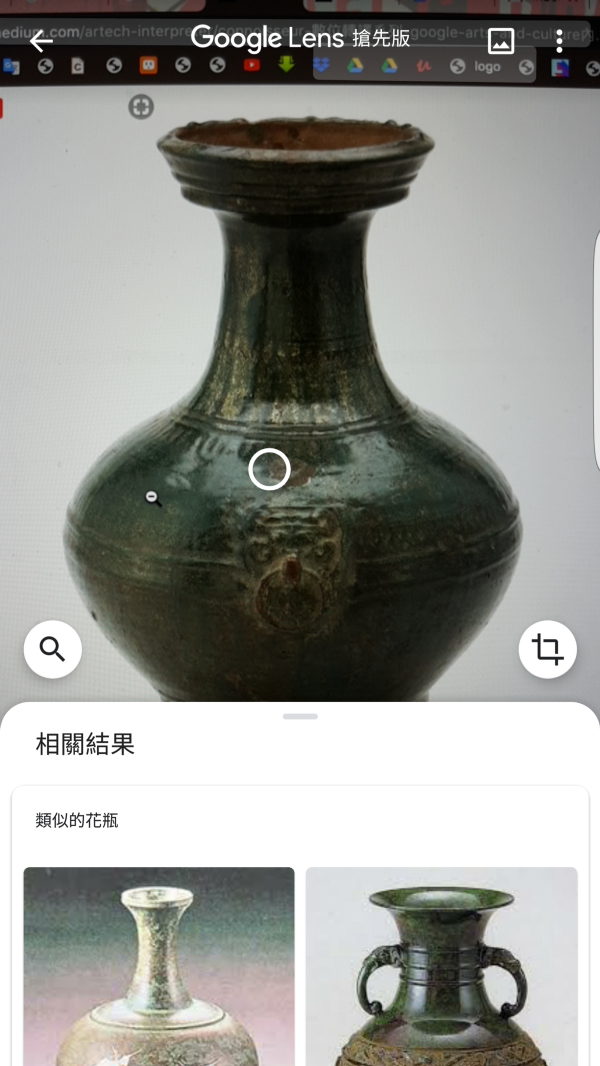

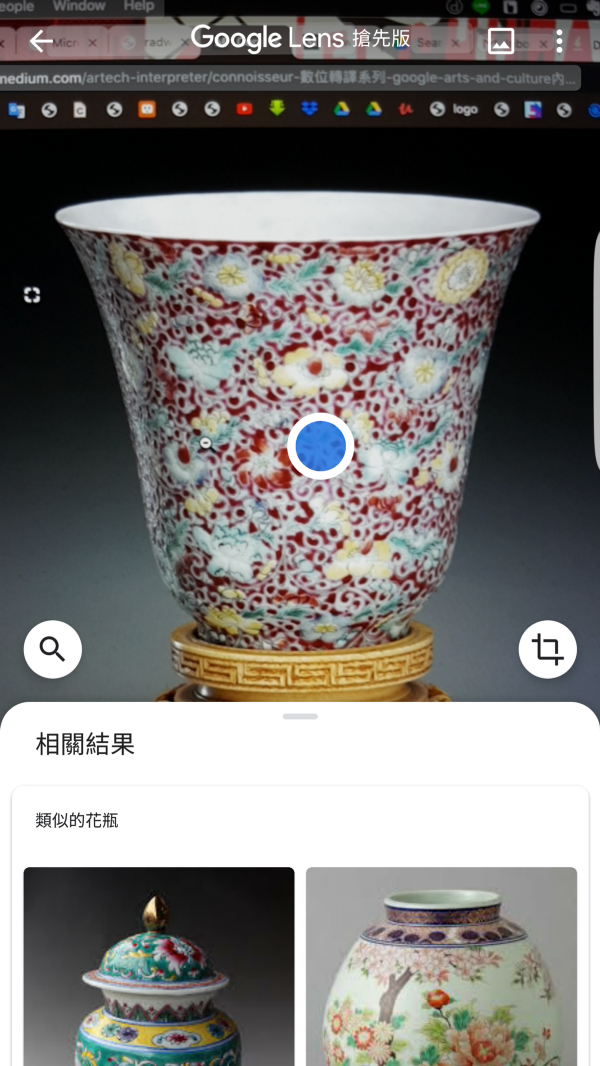

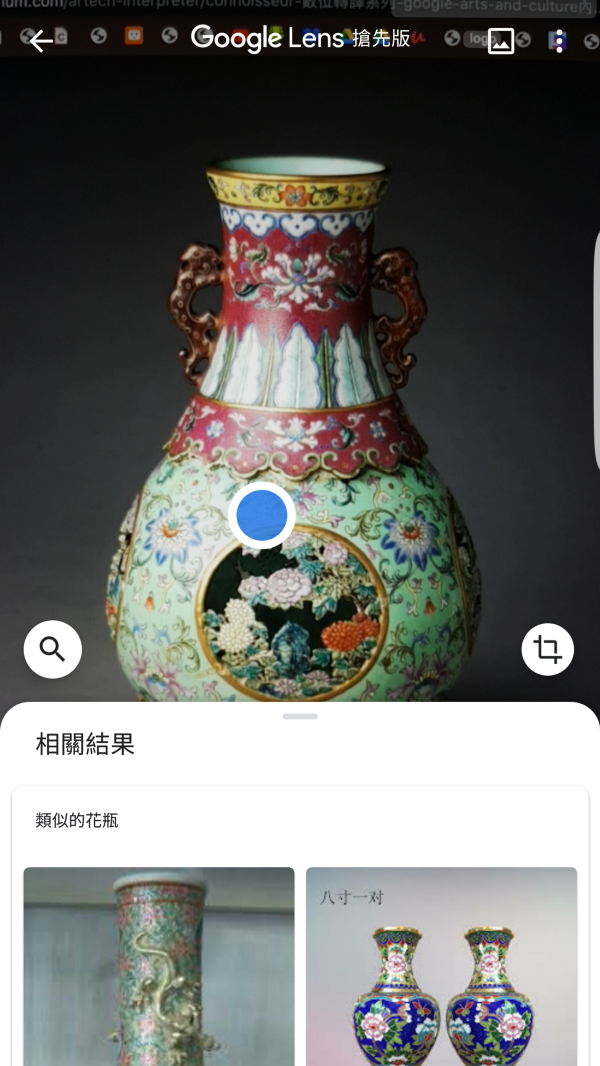

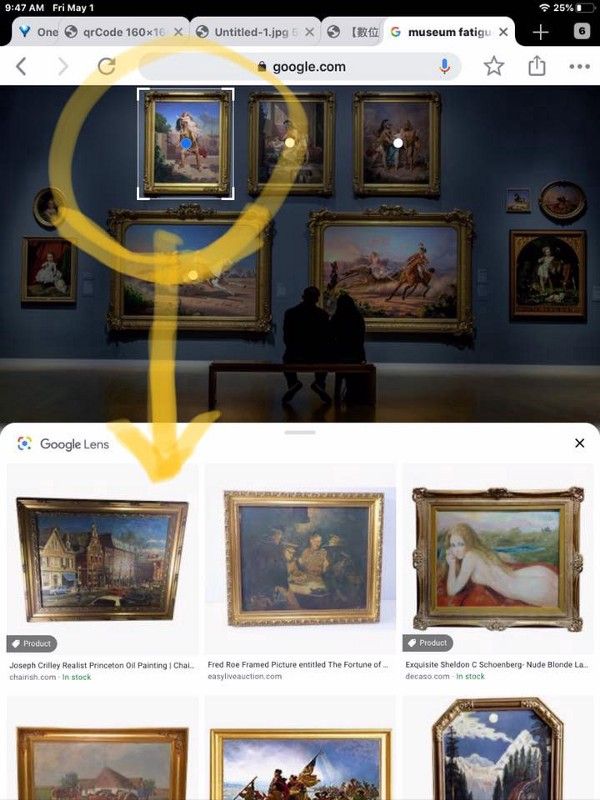

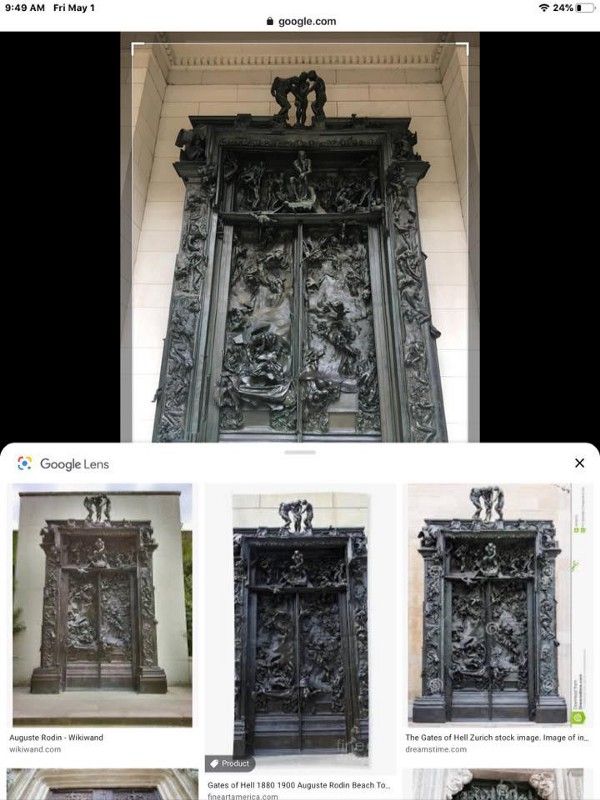

就像我在本文附上的以Google Lens 的測試照片,都是我今天在赴本校新竹校區上課的車程中測試該軟體的螢幕截圖。

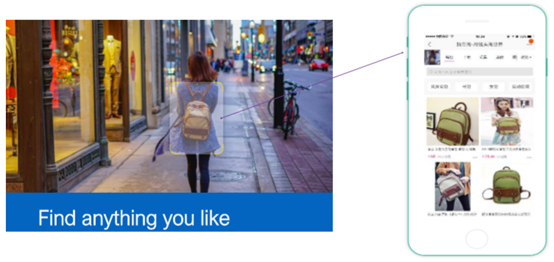

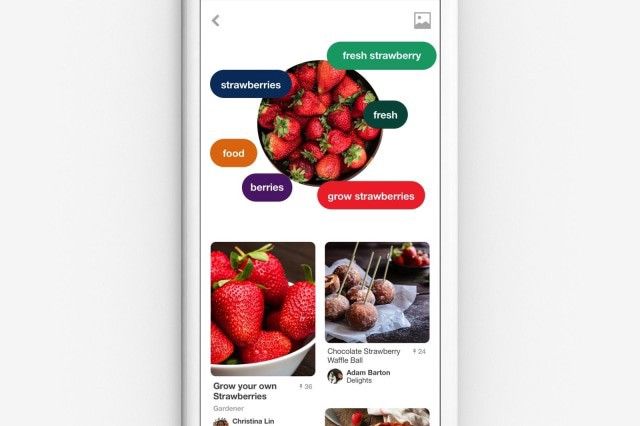

也就像Google Lens App的 宣傳廣告詞「Search What You See」(註 4)一樣,我的使用經驗是隨拍隨用,不管是:文字辨識(text)、文字翻譯 (translate)、物像搜尋(search)、物像購物連結(shopping)、攝像辨識地點(places)、食材菜單辨識(dining)等功能,都很即時即效。

事實上,我早在2019年Google Lens 只能再Andriiod系統使用時,就以逆向工程方式以Google Lens 測試我從Google Arts and Culture所選編於專文中的數位典藏圖片是否以「物像搜尋(search)」功能找回其原始網址,答案是可以的,而且我將相關測試結果寫在【數位轉譯/博物館科技系列:「Google Lens 智慧鏡頭」應用測試~〖Beyond Decoration/釉上彩工藝〗 數位圖文】一文中。

而在某次試圖整合「數位典藏庫加值應用」+「圖像掃描式導覽查詢服務」功能的想法後,邊紀錄實測結果,邊增加了很必要的「自動標籤與連結」+「機器學習 machine learning」的檢視後,也寫成了【數位轉譯系列:從BYOD談數位典藏資料庫隨行的可能性】(https://reurl.cc/0O1Kyb) 。

此兩篇都是我對於「機器視覺」技術與應用的正面態度,也因此現在繼續延伸成此篇~【智慧鏡頭的IoE (Interfaciality of Everythings 萬物介面性)論】。

二、支援IoE的軟硬體現況

也就是因為Google 致力於資料的搜尋與連結之技術與內容的開發,因此各種形式的「Google Searching 」,不論是圖文、攝像、色彩揀選、臉部辨識、GPS等等輸入方式,與鏈結選項、文字、圖片、影片、3D檔案、路線等等輸出內容,都使Google 搜尋能為以鏡頭攝取資料的IoE (Interfaciality of Everythings 萬物介面性)應用充滿未來的可能性與期待。而這些都能在前面介紹的Google Lens (App)使用上體驗得到。

寫到這邊不得不提起於2013年發表的,且曾被選入失敗博物館展件之列的「Google Glass」。那安裝在眼鏡框架上的「500萬畫素攝影鏡頭+640X360像素LED背光顯示螢幕+ 2GB RAM+雙核處理器+觸控板(太陽穴附近)+語音控制」到了2020年第二代「Google Glass Enterprise Edition 2」已是「800萬畫素廣角攝影鏡頭+640X360像素LED背光顯示螢幕+ 3GB RAM+3核處理器+觸控板(太陽穴附近)+語音控制」。

雖然Google眼鏡隨配的鏡頭使之在公共場合的使用有隱私權的疑慮,專注又眼前的顯示螢幕也有分散注意之虞,加上售價過高、效能普通,第一代在推出兩年多後停產,而第二代「Google Glass Enterprise Edition 2」在於2019年中推出,售價仍達 1,000元美金,依其產品命名就看出是鎖定企業市場,所以市場聲量一直不大。這狀況也跟微軟的Hololens狀況一樣,當Hololens停產一段時間,而Hololens 2再於 2019年2推出時,也以3,500美金的高售價鎖定企業用戶。至於還未面世就充滿話題的Apple AR 眼鏡,或者是原本被視為MR甚至CR (Cinematic Reality劇院實境)黑科技的Magic Leap,甚至是臉書旗下Occulus VR 軟硬體公司在最近所推出的Occulus Quest 2 (註 5)等等也都是過去這類技術針對虛實整合環境的數位應用所推出的高科技載具,而且也乘載著一種非常未來感的數位使用環境的期待。

我在2019.9.28發表的【數位轉譯/數位科技系列:Virtual Immersion or Mixed Reality】(https://reurl.cc/n0Dy8n) 一文中,就曾以虛擬沉浸與混合實境的角度關注過這些大廠的新產品在營造未來AR世界所展現的想像力與實務研發,的資源與實力,不得不樂觀的期待,這些擁有先進軟硬體研發技術的大型公司,要為人類在未來建置一個更緊密結合我們現存的生活空間的「planet-scale AR」,其實已經不再是純想像了。

三、基於IoE概念的論述

因此,基於「數位轉譯」理論論述的必須,我在此提出更關注於數位資料/知識內容之應用的「IoE (Interfaciality of Everythings 萬物介面性)論」,目的就在於:

1. 動態與實務策略的調校:

我提出「發現驅向型策略(DDS discovery-driven strategy)」的角度去審視即時性的數位策略與作為,以時間推移之發現而產生的需求去啟動必要的調整,且是以數位應用的軟硬體研發進度為據。或許這是種不符合政策(例如博物館/美術館數位典藏政策)的軟性/消極概念,但確實也比較務實且符合人性。世事難求周全,必須時時補綴。從這樣的觀點來看,「發現驅向型策略」或許就是在維繫問題解決流程的關注性上,一個具有持續性的策略方法,特別是保持與數位技術研發不斷推進的必要距離。

採用「發現驅向型策略(DDS discovery-driven strategy)」會視需要去調整「資料的數位保存策略與作為」、「技術的數位應用策略與作為」、「人機互動的數位因應策略與作為」等等,且認為這是更務實的做法,也類似時數位策略的「包容性設計 inclusive design」概念,能面對不同的差異與條件。

2. 在空間中聯通另一知識世界

從虛擬技術的觀點去談「空間」的話,沈浸感(immersion)就會是其中的重點,而不是「介面性(interfaciality)」。但介面才是橋接其他視覺世界或感官體驗的樞紐。所以我在此篇數位科技論述中所關心的是:在空間中聯通另一知識世界的介面。「介面」就是種鏈結的按鈕,或啟動的鎖鑰,如果沒有這種在空間中佈局的介面元素,我們所存在的或正沈浸的空間,就也只能是個固定的處所,沒有其他的可能性與探索的深度。

此外再加上目前在數位敘事上,已不強求建立敘事脈絡之「普同性故事universal story」而忽視物件作為個別存在的價值,反倒是因為更強調知識的形式性 formality、中立性neutrality和客觀性objectivity,而使個別物件都能在敘事中佔有一席之地。使用者/訪客/觀眾不僅能「入戲」地黏著在敘事內容中,也能有意識地/或經設計的「出戲」,才能使之有選擇跟互動性,為全虛擬或虛實整合的數位視覺世界保留其「介面性」。就是在這樣的論述邏輯下,期待在目前已在使用的擴增實境(甚至是3D虛擬空間中)找到「空間介面性」。

近年來的ARCore與ARKit技術不僅能透過鏡頭偵測平面,使3D物件與實境空間更密切連動,加上2020.4最新發表的iPad Pro上更搭載 LiDAR Scanner去實現高效能「地景測繪 scene geometry」與「即時AR成像instant AR」 技術,進一步使重組空間成為實現沉浸體驗的twilight zone,那是個在虛實之間、在儀式之中的「閾界」(liminality)。 目前的實際應用請參考以下的影片。

四、結論:

目前也在臉友動態上看到幾個在數位應用上的落實,像是個人的數位轉譯戰友~賴志婷所分享「科技導入很溫暖的平凡一天」中的Hololens 2在故宮書畫展區的應用;蔡遵賢老師目前正進行中即將露出的國圖展區的Magic Leap數位應用(個人根據其動態所做的判斷),個人很期待去了解這些應用的成果,也會去據以驗證自己在「IoE (Interfaciality of Everythings 萬物介面性)」方面的論述。

韓炳哲在【數位狂潮下的群眾危機】曾提到「數位溝通的效率與便利性…..我們也越來越不願意接觸真實事務。數位媒體成為我們與真實事物之間的阻礙,同時也日漸抹除我們周遭的真實事務」,甚至還說「數位科技徹底改造了拉岡(Jacques Lacan)所提出的真實界、想像界,以及符號界的三位一體結構」。(註6)因為韓炳哲認為真實被解體了,想像被總體化了。

確實,若以目前的VR與數位網絡的虛擬沉浸技術來看,確實連博物館界教育較都會關心虛與實被切割的議題,再加上AR/MR技術因為載具硬體上無法有效支援軟體的進展,主要是因為沒有 AR眼鏡之類的設備所造成非主觀視覺與直覺,所以真實物件無法連結想像知識。

但我曾提出「內容/展件・形式/參與・呈現/轉譯」之三元結構,例如介紹透明螢幕數位設計的三元結構。非根據拉岡的理論,也是援引Dudley, S. (2013)所編的Museum Materialities: Objects, Engagements, Interpretations一書。書名所分列的三大項構組了博物館的重要實體,亦即:objects 展件、engagements 參與、interpretation 轉譯等項,正好也是以「使用者中心(user-centered)」與「資訊導向(information-oriented)」的實踐目標為設計主軸之數位技術的基本架構。而作為檢視多媒體展示技術的博物館應用,且以內容(展件)、形式(參與)、呈現(轉譯)為標準。我認為「IoE (Interfaciality of Everythings 萬物介面性)論」將整合拉岡(Jacques Lacan)真實界、想像界,以及符號界的三位一體結構」,以及前述的出「內容/展件・形式/參與・呈現/轉譯」之三元結構 (見我畫的示意圖)。

因此,以目前所看到的Google Lens能透過攝像輸入、辨識確認、資料輸出所提供的「萬物+資料」應用,以及各大公司的各式頭戴式裝置所積極地在AR/MR/XR的技術進程中於真實世界數位服務上所提供「實境+虛像(planet-scale AR)」應用,使我在此針對現在與未來的數位感知之必要性,提出「IoE (Interfaciality of Everythings 萬物介面性)論」。

幾篇隨筆所慢慢建構體來的「空間+介面」之邏輯。但除此之外,也必須從數位科技的當下發展提供可行性的驗證,在此要分享的就是多款遠距會議軟硬體所提供遠距視訊應用,以及AR/VR新科技與產品的所建構的虛擬沈浸Virtual Immersion體驗。

畢竟將「Google Lens」用在展場,作為「圖像掃描式導覽查詢服務」其實並非新概念與用途,因為「Smartify」這款整合30家博物館展品資料的圖像辨識與資訊服務App(雖然不是全部採用AR辨識技術)。「Smartify」只要拍攝展場中的展品,即有該作品的詳細資料呈現手機視窗中。「Smartify」的宣傳標語就是:「Scan the art, uncover the story」,因為Smartify是進階版數位導覽服務,隨時掃描任何想進一步了解的展場展品,就可以取得以圖文與多媒體內容的導覽資訊服務。

對於落實「IoE (Interfaciality of Everythings 萬物介面性)論」關鍵概念有三:「主動搜尋」、「簡易搜尋」、「進階搜尋」,其終極目標就是掌握「BYOD (Bring Your Own Device)」的趨勢,追求虛實知識的整合,提供個人化與客製化的即時數位應用服務。

註釋:

註1: Scottie Gardonio (2017)就曾於「What’s the Difference Between VR, AR, MR, and 360? Know the difference to make sense of our new digital worlds」將混合實境技術定義為:「有即時定位與地圖構建技術,並且可以進行3D即時運算做相對應的改變,也更具有擬真的虛實整合效果。」也因此混合實境的Mixed Reality之稱,不僅在強調與空間建構虛實整合技術的應用上而自然與AR擴增實境有別,其MR因之也稱作Merged Reality。但必須強調的是,隨著AR應用在空間辨識技術上不斷進化,且更為簡易直覺,且在Apple ARKit 3.0 在2019年6月發表的People Occlusion (人物遮檔)技術,不僅「將虛擬物件隱藏在真實物件之後 hiding virtual objects behind real things.」,且透過景深偵測(personSegmentationWithDepth),也能判斷AR虛擬物件與實際空間/物件之間的前後,使AR技術也能跟MR一樣處理出更接近真實世界的樣貌。也因此不僅AR與MR的虛實成像效果會越來越趨近,也勢必朝向為實物呈現虛像的數位效果去共同演進。

註2 :MR技術與應用過去因為與Magic Leap、Hololens !&2、Acer AH100 MR Smart Glass等頭顯載具所提供的主觀視點結合,使之與頭戴式顯示器還沒有實用型(也就是所謂的AR Glass)而多以行動載具視窗為主的AR,在使用形式上就有所區別。但相信在Apple AR Glass正式問世後,AR可預期將涵括MR,並成為實境+虛像整合的最突出技術與應用。

註3 :機器視覺可說是工業自動化系統的靈魂之窗,從物件/條碼辨識、產品檢測、外觀尺寸量測到機械手臂/傳動設備定位,都是機器視覺技術可以發揮的舞台,因此它的應用範圍十分廣泛,行業應用領域更是多到令人眼花繚亂。 圖像辨識,是利用機器視覺對圖像進行處理、分析和理解,以辨識各種不同模式的目標和對象。(摘錄自:【機器視覺的 5大典型架構與 5個常見領域】https://reurl.cc/GrAno3)

註4: Google Lens 官網。https://lens.google.com/

註5: 目前Occulus Quest 2的售價為299美金,號稱是款 All in One VR的設備。雖然目前官網(https://www.oculus.com/ )並沒有正是提及此系列VR載具與實境結合應用的AR功能,但自從2019年於OC6大會發表Occulus Quest一代釋出Live Maps的虛實整合應用技術後,2020年發表的Quest 2也據傳將在2021年釋出API,並且使用Passthrough+電腦視覺運算技術進軍所謂的AR/MR應用(資料來源:https://reurl.cc/Q3XmQ0)

註6: 韓炳哲. 王聖智譯 (2020). 數位狂潮下的群眾危機. 一行出版.

喜欢我的作品吗?别忘了给予支持与赞赏,让我知道在创作的路上有你陪伴,一起延续这份热忱!