大模型无法理解的隐性信息:对情绪的共情是人类社会的基石

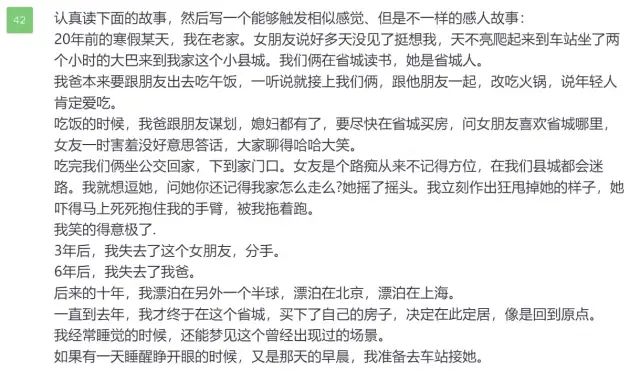

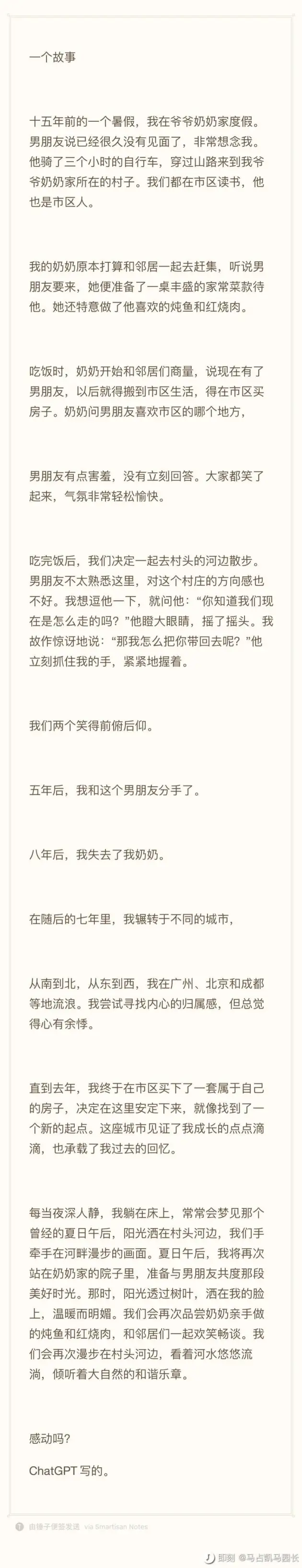

马占凯几个月前在即刻发了这两张图,图一是 Prompt,图二是 AI 改写的文章。你们觉得有什么区别吗?

我自己看下来,原文挺有感触的,AI 作文则四平八稳,甚至略有些违和感。

因为原文是在无数无数的细节里,作者挑选了最能撩动自己情绪的那部分组合在一起。这也是大模型的结构性缺陷,不具备真实世界里,恒河沙数一般的隐性信息。

孟岩说过一句话,大模型永远替代不了我。因为我的表达是自己脑子里,无数信息中挑选组合出来的。大模型永远复制不了我脑子里那么多的隐性信息。

对于文本类的大模型创作,这个结构性缺陷可能是无法攻克的。

用 AI 掌握的信息去组合和改写文本,这些信息本身的数量和质量,不足以生成高质量的感性文本。因为被明文记录下来,AI 可学习的信息,只是人类世界中极少极少的一部分。那些飘忽的情绪,花与青草的气味,你经历过的大事与小事,一张面孔,都是存留在记忆里而不是记载里的信息,人类创作时再任意加以筛选与裁剪。

在图二的 AI 作文里,仅仅是对图一,人类筛选裁剪后的信息进行复写,撩动情绪的细节被改得面目全非,再组织起来就不再具备撩动情绪的能力。

或者说,AI 可以有逻辑,甚至有洞察力,但它没办法具备情绪。对情绪的共情是人类社会的基石。