机器觉醒?人工智能当下的危险

今天聊聊人工智能。

这几年火热的人工智能其实并不是一个新概念。2016年谷歌的AlphaGo在围棋比赛中战胜李世石,人工智能再一次引起了各行各业的关注。谷歌DeepMind在人工智能上的突破,也促成了人工智能技术在各行各业的应用尝试。

人脸识别,语音识别,文字识别,机器翻译,自动驾驶系统,推荐系统等等这些基于人工智能的应用正在改变着相关的各个行业,也在改变着我们的生活。同时人们又一次开始担心人工智能的潜在危险。

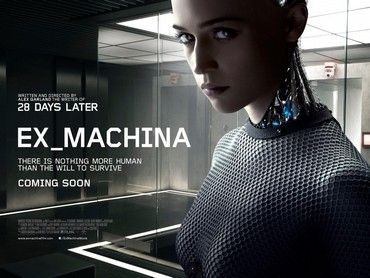

谈起人工智能、机器学习的危险,我们常常会联想到机器的觉醒,原本服务人类的机器开始反抗,甚至要与人类为敌。但AI和机器学习对人类的挑战,以目前的发展水平,显然机器觉醒还不是人类目前所应该担心的。

但机器学习的广泛采用也确确实实对人类造成了切实存在的威胁。目前现实生活中人工智能的两大主要应用是图像识别和推荐系统。其中图像识别,特别是人脸识别,正面临严厉的监管。人们一方面担心信息泄露,另一方面担心个人信息误用。而随着监管的深入,人脸识别所带来对个人隐私的侵犯,尚不足成为主要的威胁。

推荐系统是机器学习的另一个重要的应用。基本上目前我们所用的各种网络服务都采用了基于AI的推荐系统。我们常常会惊讶系统推荐的准确性。打开购物软件,心里想的东西可能已经出现在推荐框了。刚看完一个视频,类似一大堆的视频跳出来,不知不觉已经过去大半天。人工智能通过观察和分析用户行为,给用户推荐最适合的产品与服务,这看起来完全是人畜无害。当然也不会面临太多的监管,但也正因如此,这种人工智能系统对人类个体构成了实实在在的威胁。

人工智能在一定程度上,特别是在言论自由有限的空间,正在重塑我们的意识,并加深群体偏见。人类的决策其实也是一种算法,其中个人经验和通过视听所获取的他人经验,是个人做出决策的关键。随着人们花在视频和网页阅读上的时间越来越长,甚至于超过和现实互动的时间。相比社交活动,人们更愿意躲在家里看视频。虚拟网络空间占用的时间甚至超过了人们和真实世界的互动。在这种情况下,这些视听内容将和现实世界一样会逐渐改变我们的认知,从而也一定程度上影响我们的决策。在承载这些视听材料的网站,人工智能技术被引入,引导用户发现内容,并占用用户尽可能多的时间。对网站来说,引入人工智能的目的不是提高信息的中立性,而是为了增加网站和视频的点击率。其中一个例子是基于人工智能推荐的新闻网站。人工智能将点击率、阅读时间、点赞、评论、转发包括点赞进行量化,对用户进行标签化,并针对用户感兴趣的类别和主题、关键词、来源、兴趣,年龄、地点等进行推送。如果用户只依赖于该类网站获取信息,逐渐人工智能将只推送符合用户价值观的新闻。这个过程中,用户通过点击等行为,训练了人工智能;但另一方面,人工智能也在进一步强化用户的思维模式。一个有偏见的思维,通过找寻同道,将进一步加强偏见。由于获取信息的单一化,该过程将大大加快,从而人工智能也完成了对个人意识的强化甚至训练。当该思维模式开始影响该用户的决策时,用户将无从分辨该决策是自己的主观决定,还是由于人工智能对该用户的驯化的结果。加强用户偏见,显然是人工智能信息推送最有益的策略。以前由于人们获取信息的多元化,不同信息的冲击,将有助于改变用户的偏见。如今,人们获取信息来自单一网站,比如今日头条等,各种缺乏中立性的信息,甚至虚假信息,由于符合大部分人的偏见,更容易传播,从而也更容易影响人的思维。所以一定程度上,人工智能在改变着人的思维模式,将思维模式固化,甚至加强群体思维偏见。这个驯化的过程是温和的,甚至是愉悦的。但这个固化偏见的思维模式,对于个体来说危害巨大。人工智能推送的内容让他认为世界上大部分人都是他的同道中人,从而在虚拟世界获得了群体认同。但现实并非如此。认知和现实的隔离,必将在某一刻以某种方式,产生冲击,并造成个体判断和决策失误。

另一个问题是人工智能技术能够改变这些缺陷,避免给用户标签化么?答案是不能。推荐系统,本身就是对用户进行打标签。相比人的多样化,标签永远是有限的。所以最开始谷歌用人工智能技术对邮件进行分类。但对客户进行标签化,并针对标签推送相关的内容,对于营销来说无疑是最有效的。这也就以为这种技术将被更广泛的采用。

如果你发现自己的观点和理念似乎变得越来越正确,很难在网络上看到与其相左的声音,多半情况下,不是“从心所欲不逾矩”,而是网站为你屏蔽了你不喜欢的声音。

个人如何对抗这种人工智能的驯化呢?

1. 开拓多元化的信息获取渠道,摈弃以点击量为目的的新闻推送媒体。

2. 如果无法避免,尽量采用匿名身份进行登陆,避免人工智能收集过多信息,对个人进行标签化。

3. 不断学习,并创造内容,以自己的思想和知识,创造思维的多元性。

但悲观的是,这个驯化过程无法避免,因为整个社会正在被驯化。终究我们难以逃开群体效应。言论自由,并能够在公共平台正常进行思维的碰撞,思辨是对抗这种驯化的关键一环。