我是人,不是機器的薪火

「AI 教父」Geoffrey Hinton 高調離開 Google,因對人工智慧抱有倫理顧慮

查了一下 Geoffrey Hinton 是何許人:以推廣 AI 為畢生志業的先鋒者,2012 年開發出基於神經網路(neural network)技術的圖形辨識系統,成為當今 AI 的重要基礎。

這句話另一層意思是,不過才十年,AI 成熟度已突飛猛進,時下當紅的生成式 AI(generative AI)更讓「取代人類」的警語不再是警語。無怪乎倫理議題自然而然成為 AI 所衍生的炎上話題,但同時也別忽略了我之前提過的隱私與智財權問題,那亦屬道德範疇。

還有一點。文中說「Hinton 認為 AI 在過去五年裡發展神速,而未來五年可能發生的事情將是『非常可怕』的。不過 Google 首席科學家 Jeff Dean 強調他們仍將致力於採取『負責人的方法』,並對『新出現的風險』保持警惕。」

【題外話】什麼叫「負責人的方法」?查了紐約時報原文,這句是 "responsible approach to A.I.",也就是「對 AI 負責任的態度」。這翻譯也太爛。不過我猜是 typo,把「任」打成「人」。

可是 Google 從來都是說得比做的多啊,他們會把倫理道德置於技術研發之上才有鬼,連 "Don't be evil" 的精神口號都在 2018 年被移除了。這樁著名事件發生於「Maven 計畫」所引發的爭議最高峰時,畢竟與美國國防部合作打造軍事用途技術這種事情實在很反道德,尤其 Google 所在的矽谷,風向往哪兒吹人盡皆知。

有趣的是,許多包含資訊技術在內的新科技,都是由軍方主導開發或贊助,最有名者即為 Internet 的鼻祖 ARPANET。

但身為民間企業,你可以有你的道德價值,你的員工也是。

譬如 Geoffrey Hinton 過去就曾經辭掉卡內基梅隆大學的研究工作而轉赴加拿大,正因為美國許多 AI 計畫都是五角大廈出錢的。有此前例,他現在辭掉 Goolge 的官位也不令人太意外。

不願意跟軍事扯上關係,其實是許多公司所重視的倫理價值。像是以兒童為主要市場的樂高,就絕對不出現代軍事武器的產品。可能有人看過軍武積木(到處都買得到),但那其實都不是樂高原廠的。樂高的磚塊本身專利早過期,任何人都可以推出他的模型盒組(只是原廠產品仍有 IP,他人敢照抄就是侵權),但那都不是原廠的產品。

我現在服務的公司也是,上次我們部門規劃 team building 的 outing 主題,大家投票決定去打雷射槍——還不是漆彈唷——卻被總公司活動策劃部門否決,因為那會「助長衝突」、「破壞情感」。後來我們只好改成去打保齡球,這公司就同意了。是說打保齡球組隊互相競爭就不會「破壞情感」喔?

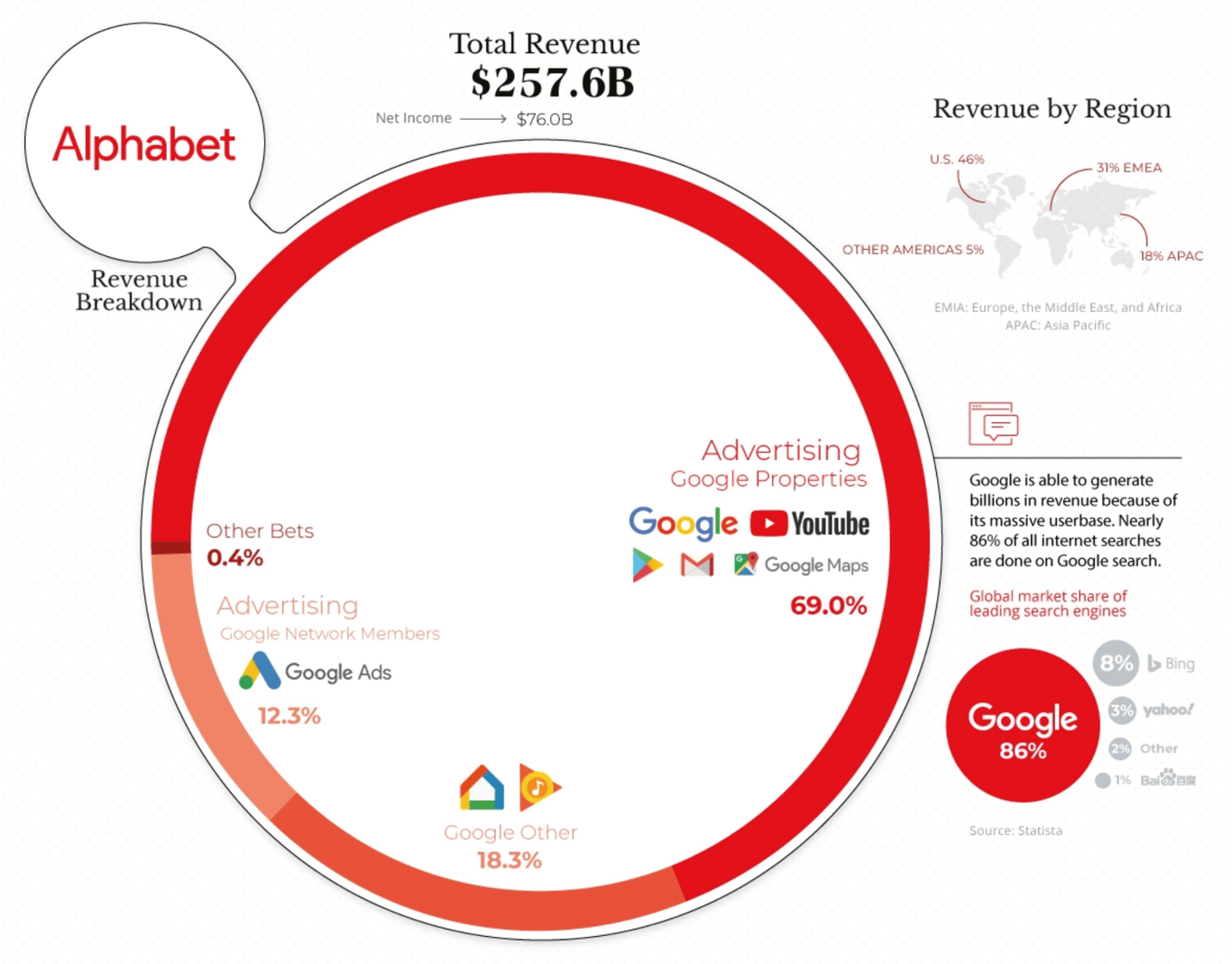

無論如何,身為民間企業,可以有所為有所不為。可若當你的營收超過八成來自廣告相關事業,你說你不會出賣使用者隱私,叫我怎麼相信你?你可以賣我的個資去做廣告,難道就不會將我出賣給政府?去讓我變成機器學習資料集中的一部分,還反過頭來取代我、危害我、笑我不懂尊重你?

身為二十多年資訊業老屁股的我,從來認為科技可以帶領人類文明的前進,其價值不該被保守者斲喪。但科技源之於人也用之於人,「如何保護人」才是它的「人賦使命」,這道理在「機器人三大法則」被提出的八十年後愈發明光鋥亮。不要真搞到需要能夠區分真人和仿生人的「孚卡測試」(Voight-Kampff Test)出來才知道覺悟,艾希莫夫和 PKD 早就警告我們過。

我是人,不是機器的薪火。

喜欢我的作品吗?别忘了给予支持与赞赏,让我知道在创作的路上有你陪伴,一起延续这份热忱!