我和AI共同創作了這篇文章,主編說乾得漂亮明天不用來了

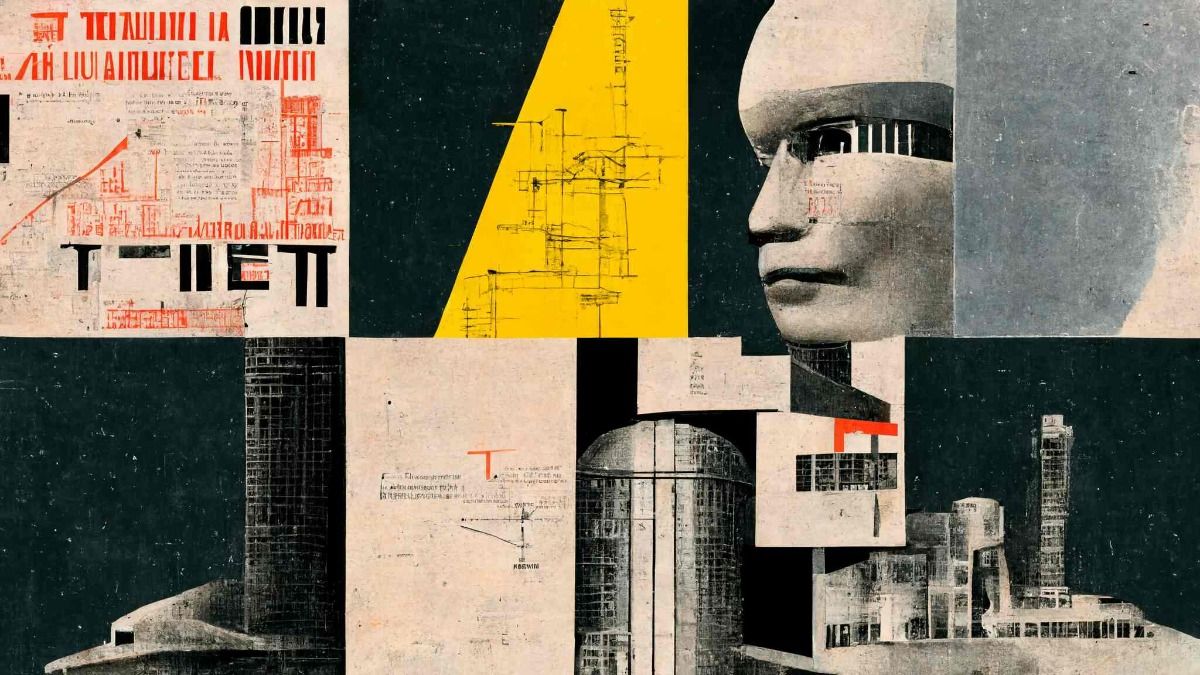

大部分文藝工作者,比如寫字的,畫畫的,作曲的,失業風險都在攀升——本文的所有插圖均由AI創作。但文字是我自己寫的,如假包換。

最近Open AI的Dall-E 2創造的一系列精美畫作,以及結合微軟Florence和OpenAI GPT-3模型寫出來的文本,都證明了AI有時候看著是比人強。今年叫AI文藝創作元年也不過分,通過給定的文字或圖像,AI能產出超乎想像、大膽有趣又合情合理的作品,確實不乏“劃時代”的意義。

這些進展建立在巨大的“基石模型”基礎之上,令AI擁有了創造者不曾預見的能力。過去的人工智能模型,帶著手工作坊式的“粗糙”。通過長期的調整,“基石模型”的潛在能力已經成為肉眼可見的發展趨勢。

人工智能要進入工業大生產時代了。

大模型,下崗工人製造機

5月份出了beta版的AI繪圖工具Midjourney,連雜誌《經濟學人》也忍不住“嚐鮮”。 Midjourney為《經濟學人》報導畫的插圖,看起來靈氣十足,具有強烈的現代主義風格——別忘了,畫面可是基於非常抽象的概念生成的,畢竟文章內容不是“一位女人抱著一隻貓”這種具體記敘。

Midjourney其中一位開發者,就是研發YouTuber Quick-Eyed Sky的Disco Diffusion的創作者Somnai,這些應用都屬於“你說我畫”,或者叫輸入關鍵詞就出圖。 Disco Diffusion非常火爆,但相比DALL-E和Midjourney就略帶“門檻”,要自己調代碼,調參數,目前更火爆的應用都是“傻瓜”型的,寫點文字就行。

玩“你說我畫”會上癮。 Twitter上的馬斯克、特朗普、斯嘉麗·約翰遜以及瑪麗蓮·夢露都要被“玩壞了”,個個都有“猛鬼街”的造型。國內滴墨社區兒童節上線的“Domo大畫家”,在我刻意“刁難”的情況下,給出的畫面還是饒有趣味。

輸出的作品效果如何,完全取決於AI模型。而打造AI模型,相當於豪華軍備競賽。

目前拿得出手的“基石模型”,有OpenAI的GPT-3,參數接近2000億,耗資超過1000萬美元;谷歌的Switch Transformer,參數超過GPT-3;微軟和英偉達有MT-NLG模型,參數超5000億;華為盤古大模型,定位中文語言預訓練模型,參數規模也達到千億級別。

2020年GPT-3剛“誕生”的時候,就得名“下崗工人製造機”。其輕鬆通過了人工智能屆的底線試探——“圖靈測試”,所有問題對答如流。基於GPT-3模型開發出來的文字、翻譯、設計、計算等應用,都能頂替人類的操作。

甚至有個人想讓GPT-3寫篇“論刷Twitter的重要性”的小論文,GPT-3都給他寫得流暢自然,還用上了寫作者的高階操作“春秋筆法”,也就是陰陽怪氣。它說”Twitter是“所有人都使用的、充斥著人身攻擊的社交軟件”。

基石模型的優點明顯。一是參數大、訓練數據量大,不僅不會邊際效益遞減,反而極大地提高了AI自身的能力和運算突破性。二是使用的小樣本學習方法,AI不用一遍遍“從頭開始學”,可以碎片化選取自己需要的數據來自動執行。

基石模型就相當於“通用技術”。 1990年代,經濟歷史學家將“通用技術”比如蒸汽機、印刷機、電動機等,視為推動生產力長期發展的關鍵因素。 “通用技術”包含核心技術快速迭代、跨部門的廣泛適用性和溢出效應等特徵,從而刺激產品、服務和商業模式不斷創新。

今天的基石模型,已然具備了同樣的特點。

神經網絡+自我監督學習,神乎其技

當下,超過80%的人工智能研究都集中在基石模型上。像特斯拉也在構建一個龐大的基石模型,為自動駕駛服務。

要理解斯坦福大學人工智能研究院院長李飛飛所說的“人工智能階段性的變化”,就要知道基石模型和過去的人工智能模型有何不同。

如今所有的機器學習模型都立足於“神經網絡”——模仿腦細胞相互作用方式的編程上。它們的參數描述了虛擬神經元之間連接的權重,模型通過反複試驗權重,被“訓練”到能夠輸出開發者想要得到的特定內容。

過去幾十年裡,神經網絡都處於實驗階段,沒什麼能落地的。直到2000年代末、2010年代初,超級計算機算力增強,互聯網提供了足夠多的訓練數據,在硬件和數據的加持下,神經網絡才開始完成文本翻譯、語音指令解釋、不同圖片中識別同一張臉等此前“不可能完成的任務”。

特別到了2010年代,機器學習和礦機一樣也用起了GPU。 GPU的特點是,有上千顆流處理器,可以進行大量且重複的一般運算,而且還不貴,比啟動一次超級計算機便宜太多了。

突破出現在2017年。當時谷歌的BERT模型使用了新型架構,不再按“慣例”、依照順序處理數據,而是採用了同時“查看”所有數據的機制。

具體來說,就是BERT一類的模型,沒有用預先標記的數據庫訓練,用的是“自我監督學習”技術。當模型在無數的字節中挖掘時,能自己找到隱藏的單詞,或者根據上下文猜測意思——和我們從小到大做的考試題特別像!整個新方法非常接近人類大腦的學習機制,掃一眼就能找到自己感興趣的東西,不用逐字逐句地去處理、消化。

經過數十億次的猜測-比較-改進-猜測的循環後,模型一般都能妙筆生花、才華過人。

不僅限於文字,神經網絡和自我監督學習技術均可以應用在語言文字之外,包括圖片、視頻甚至大分子數據庫等等。像DALL-E圖形模型,猜測的不是下一個字母組合,而是下一個像素簇。

在大模型基礎上開發的應用也是花樣繁多。除了上文提到的一系列文藝創作類應用,谷歌旗下的DeepMind推出了Gato,可以玩視頻遊戲、控制機械臂和寫作。 Meta的“世界模型”貌似要擱淺,本來是打算為元宇宙提供背景的。

酷東西或圖靈陷阱

基石模型的繁榮,對芯片製造商肯定是好消息。積極參與製造基石模型的英偉達,已經是世界上最有價值的半導體設計商之一,市值為4680億美元。

初創公司也有望藉此大展身手。 Birch AI會自動紀律與醫療保健相關的呼叫電話;Viable會用它來篩選客戶反饋;Fable Studio用AI創作互動故事;在Elicit上,人們可以靠AI工具從學術論文中找到自己研究的問題。

大公司也有大公司的玩法。 IBM的相關負責人表示,基石模型可以分析海量的企業數據,甚至從車間傳感器讀數中找到消耗成本的蛛絲馬跡。埃森哲公司人工智能項目的負責人預測“工業基石模型”即將興起,為銀行、汽車製造商等傳統客戶提供更加精準的分析服務。

雖然前景一片光明,AI作畫也激發了大眾的熱情,但不少研究者還是建議“後退一步”。有人認為,大模型依賴的大數據,並不是完全發揮了作用,一部分只是在“隨機重複”;同時一些帶有偏見的問題會引發模型的“幻覺”。去年年初,GPT-3在回答完形填空題“兩個XXX(宗教人士)走進了……”時,有高於60%的概率填寫“穆斯林”。

在“滴墨社區”刷“Domo大畫家”的動態時,首頁偶爾也會看到有用戶給AI發出不雅指令,CEO林澤浩告訴愛範兒記者,一般後台關鍵詞篩选和人工篩選會同時進行,保證社區的健康運轉。 Dall-E 2等AI作畫工具也面臨同樣的困境——和之前微軟小冰“口吐芬芳”同命相憐。

斯坦福大學經濟學家Erik Brynjolfsson擔心,對擁有類人能力的大模型的集體痴迷,很容易把整個社會帶進“圖靈陷阱”。計算機做到了很多人類做不到的事情,如今也做到了人類能做到的事情——還比人類做得好,越來越多的人失去工作,財富和權力會更加集中,不平等逐漸加大。

他的擔心也有道理。大模型耗資巨大,一般人也投資不起,背後的支撐者,不是科技巨頭,就是國家。基石模型會成為一系列服務的基礎平台,而平台也有“馬太效應”:贏家通吃,就算沒全吃掉,也給別人留不下什麼了。

藝術家們是真心喜愛這些“酷東西”的。英國作曲家Reeps One(Harry Yeff)就給模型餵了幾小時的節拍器節奏,該模型學完後能對他的聲音做出節奏化的反應。他預測“許多藝術家會使用這個工具來更好地完成自己的工作”。

作為一名記者,我也真心喜愛“科大訊飛”的語音轉錄應用。在過去,整理兩小時的人物訪談錄音,足以令一個心智健康的成年人當場崩潰。如今只需要坐等軟件出一個文本文檔即可,不能直接拿來當“對話”,但當素材看完全夠了。

最近我也在研究如何使用GPT-3來訓練自己的寫作模型。說不定,後面的文章,就是我的AI寫的。

喜歡我的作品嗎?別忘了給予支持與讚賞,讓我知道在創作的路上有你陪伴,一起延續這份熱忱!

- 來自作者

- 相關推薦